Il paradosso fondativo dell’Intelligenza Artificiale contemporanea

Costruire intelligenze senza conoscere l’intelligenza non è una provocazione retorica, ma la descrizione più accurata della condizione storica in cui si colloca l’attuale sviluppo dell’Intelligenza Artificiale generativa. Per la prima volta, sistemi artificiali mostrano comportamenti funzionalmente assimilabili a quelli che attribuiamo all’intelligenza umana, mentre allo stesso tempo la comunità scientifica riconosce di non disporre di una teoria condivisa, unificata e operativa dell’intelligenza come fenomeno biologico, cognitivo e culturale.

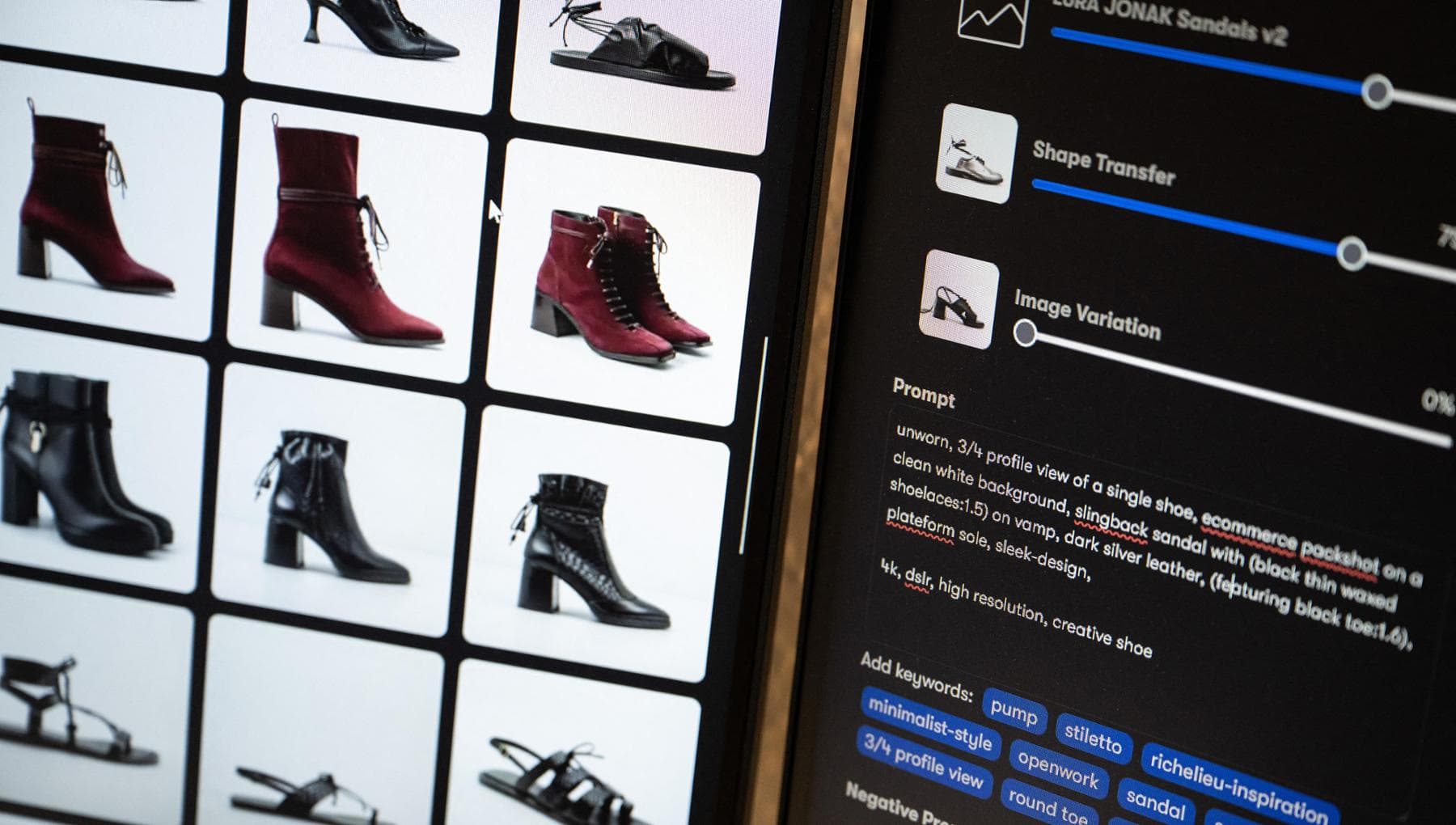

Questo scarto non è marginale. L’IA contemporanea non nasce da una comprensione dell’intelligenza umana, ma da una convergenza di avanzamenti tecnici che hanno reso possibile l’addestramento di modelli statistici su scala senza precedenti. I Large Language Models si fondano su architetture neurali artificiali addestrate a prevedere sequenze linguistiche, ottimizzando correlazioni tra simboli su enormi quantità di dati. Il loro successo non deriva da una teoria della mente, ma da una teoria operativa del linguaggio come distribuzione statistica apprendibile (Bommasani et al., On the Opportunities and Risks of Foundation Models; 2023; Mitchell & Krakauer, The Debate Over Understanding in AI; 2024).