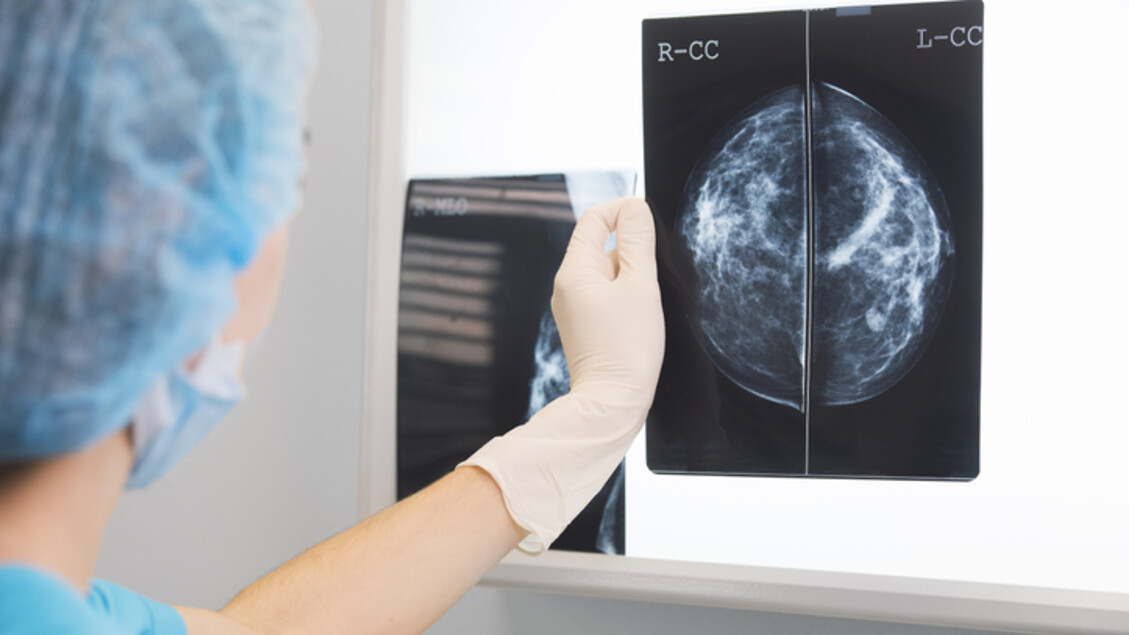

L’impiego dell’Intelligenza Artificiale (IA) nel settore healthcare ha dischiuso prospettive inedite in ambiti come la diagnosi precoce, la personalizzazione delle cure e la gestione integrata dei pazienti. Tuttavia, l’adozione di queste tecnologie comporta sfide etiche e regolatorie complesse, in particolare per quanto riguarda la sicurezza e la privacy dei dati dei pazienti. Per questo motivo, è essenziale che i sistemi di intelligenza artificiale siano trasparenti, controllabili e adattabili al contesto in cui vengono utilizzati. Tale progetto rappresenta un contributo scientifico rilevante nel campo dell’innovazione in sanità, in linea con gli orientamenti della ricerca internazionale sulla responsabilità legata all’utilizzo dell’intelligenza artificiale.

Coniugare aspetti regolatori, etici e formativi

La gestione del rischio richiede un framework integrato che coniughi aspetti regolatori, etici e formativi. In questo senso, AI Act - entrato in vigore nell’agosto 2024 - rappresenta il primo regolamento globale sull’intelligenza artificiale adottato dall’Unione Europea. Tale normativa si propone di garantire un uso sicuro, etico e responsabile dell’intelligenza artificiale, tutelando i diritti fondamentali dei cittadini e promuovendo una sicura innovazione tecnologica. Elemento centrale dell’AI Act è l’approccio risk-based, che prevede una classificazione dei sistemi di IA in base al livello di rischio che comportano, fino ad escludere quelli ritenuti inaccettabili in termini di sicurezza e diritti.