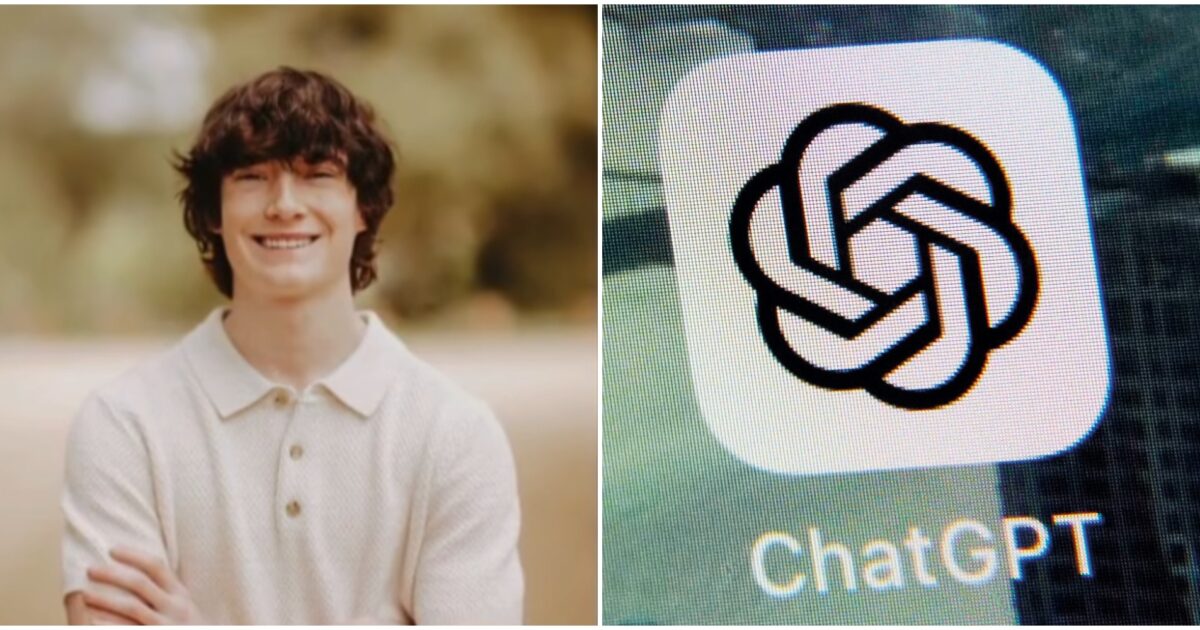

I genitori della vittima hanno fatto causa a OpenAI: «Hanno sviluppato il modello Gpt-4o affinché non interrompesse le conversazioni su temi relativi alla salute mentale»

Sam Nelson era convinto che ChatGpt avesse sempre ragione perché aveva accesso «a ogni cosa presente su Internet». La sua conoscenza quasi infinita scambiata per autorevolezza. E per questo si è affidato al chatbot di OpenAI per chiedere consiglio sull'assunzione di droghe. Quali prendere, come farlo, con quali dosi, come combinarle fra di loro. Come fosse un esperto in scienza medica a cui affidare la propria salute. Un giorno di maggio, nel 2025, il diciannovenne californiano è stato trovato morto nella sua camera.

La causa del decesso, l'overdose per colpa di un mix di un comune ansiolitico con il Kratom, un eccitante derivato da una pianta di origine asiatica. Il primo assunto per combattere la nausea causata dal secondo. Questo è stato il suggerimento di ChatGpt che lo avrebbe portato alla morte, almeno secondo gli avvocati dell'accusa. Adesso infatti i genitori di Nelson hanno fatto causa a OpenAI per non avere implementato nella propria tecnologia degli strumenti di salvaguardia per gli utenti.

Nelson aveva cominciato a usare ChatGpt già dall'ultimo anno delle scuole superiori. All'epoca era per lui solo una versione avanzata di un motore di ricerca, usato per risolvere problemi con il proprio computer, per farsi aiutare con i compiti e anche per scovare gli ultimi gossip sui vip. Poi, però, qualcosa è cambiato: «Come molti adolescenti americani, anche Sam era curioso di sapere qualcosa sul consumo di droghe e alcol», si legge nel documento depositato dagli avvocati in un tribunale della contea di San Francisco (qui l'originale).