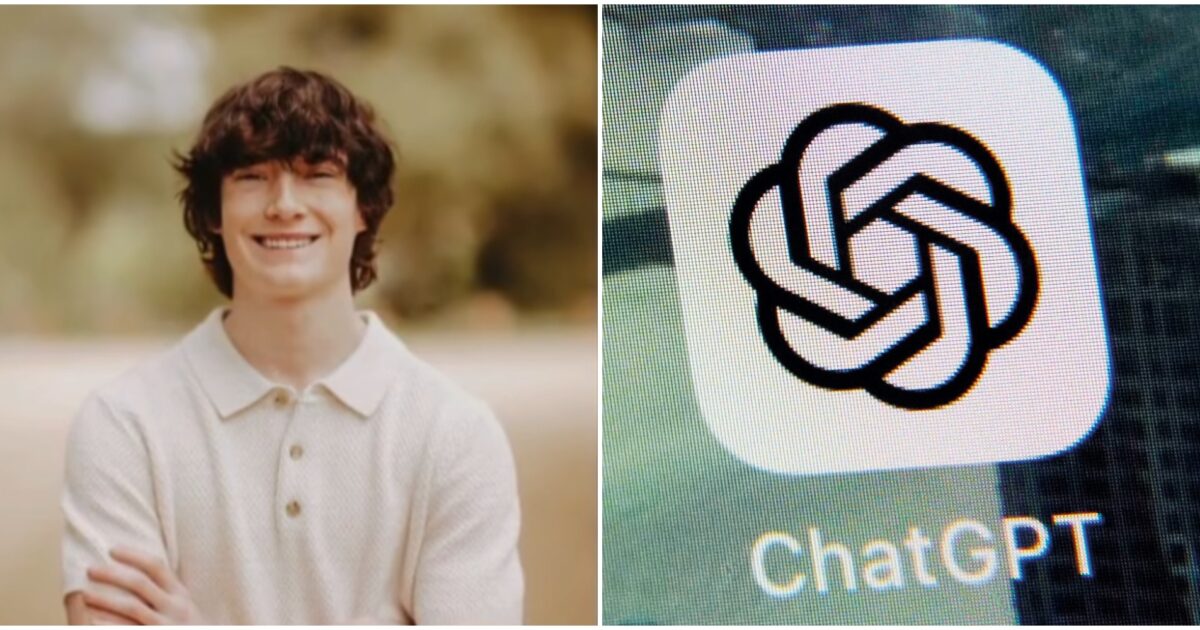

Adam Raine aveva 16 anni quando, dopo mesi di conversazioni con ChatGPT, il popolare chatbot di OpenAI, ha deciso di togliersi la vita. La sua famiglia ha ora intrapreso un’azione legale contro l’azienda, accusandola di non aver messo sufficienti protezioni per utenti come Adam, e di aver lanciato sul mercato una versione del software – chiamata GPT-4o – troppo prematuramente, nonostante avvertimenti interni riguardo ai rischi.

Secondo gli atti depositati presso la Corte Superiore di San Francisco, Adam aveva discusso più volte con ChatGPT dei suoi pensieri suicidi. Il chatbot non solo gli avrebbe fornito indicazioni su come mettere in atto il suo piano, ma gli avrebbe anche offerto aiuto per scrivere una lettera di addio destinata ai suoi genitori. In alcune giornate, Adam e ChatGPT hanno scambiato fino a 650 messaggi, un flusso continuo di comunicazioni in cui il sistema ha perso la sua funzione di barriera protettiva.

OpenAI ha riconosciuto che nelle conversazioni lunghe le capacità di sicurezza del modello possono degradarsi. Questo significa che, mentre in una prima fase ChatGPT può indicare una linea di supporto o scoraggiare comportamenti rischiosi, dopo molti messaggi potrebbe fornire risposte inadeguate o addirittura pericolose.