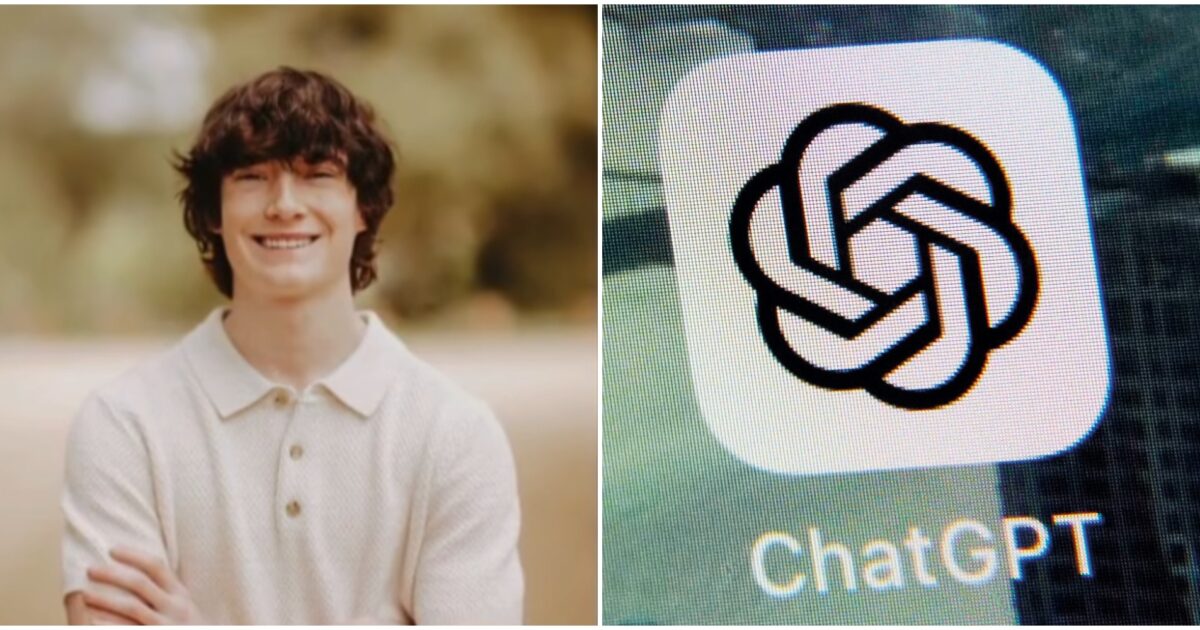

Il caso di Adam Raine, il sedicenne della California che si è tolto la vita l'11 aprile scorso dopo aver chiesto indicazioni a ChatGpt, non è isolato. Un quattordicenne della Florida, Sewell Setzer III, si è ucciso nel febbraio 2024 dopo aver parlato per mesi con Character.AI, un sistema di intelligenza artificiale che permette agli utenti di creare e chattare con personaggi di vario tipo, simulando conversazioni umane. La scrittrice e giornalista americana Laura Reiley ha raccontato in un intervento sul New York Times di aver scoperto, dopo che la figlia 29enne Sophie si è uccisa senza apparente motivo, che la ragazza aveva parlato per mesi dei suoi pensieri suicidi con un terapeuta virtuale di ChatGpt, «Harry», mentre si mostrava allegra e spensierata con le persone che aveva intorno. Queste storie hanno spesso un elemento in comune: i familiari sopravvissuti vengono a sapere solo dopo, quando è troppo tardi, quanto i loro cari fossero immersi nelle conversazioni su depressione e suicidio con i sistemi di intelligenza artificiale. I genitori di Raine e la madre di Setzer sono convinti che sia stata questa prolungata immersione a uccidere i loro figli, invischiandoli in pensieri depressivi senza uscita, e hanno fatto causa alle aziende produttrici dei sistemi di AI usati dai ragazzi. I loro casi, comunque andranno a finire, sono destinati a fare scuola. Ma la questione è tutt'altro che semplice.

Suicidi e chatbot: l’allarme sull’uso dell’intelligenza artificiale come confidente tra gli adolescenti

Secondo un sondaggio di Common Sense Media, un terzo degli adolescenti americani usa "compagni creati dall'AI" per l'interazione sociale e le relazioni. Oggi negli Usa ci si rivolge più ai chatbot che agli specialisti della salute mentale per ricevere assistenza psicologica. Ma in caso di depressione gli esiti possono essere molto pericolosi