Una investigación de las universidades de Oxford y Estatal de Utah sostiene que los grandes modelos de lenguaje aún no son capaces de razonar ni generar teorías innovadoras al estar limitados a la información que ya existe

En su obra Reflexiones del lenguaje, publicada en 1975, Noam Chomsky afirma que los niños aprenden a hablar no solo imitando lo que oyen, sino construyendo una teoría a partir de información escasa y desordenada. Según el lingüista, un niño infiere conocimiento que va mucho más allá de lo que ha escuchado y eso le permite producir oraciones nuevas, sin relación directa con sus experiencias previas. Es decir, no solo reproduce patrones, sino que crea conocimiento original.

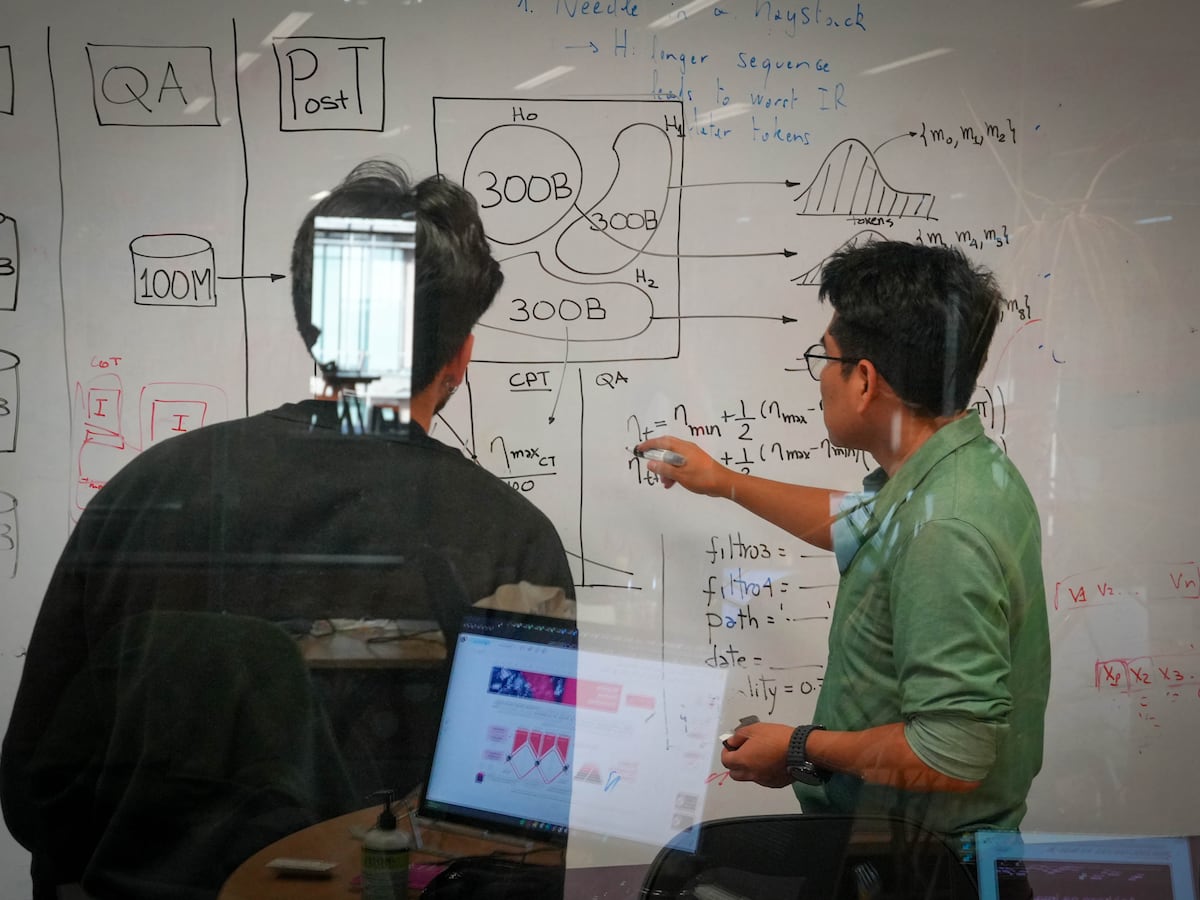

Para los investigadores Teppo Felin, de la Universidad Estatal de Utah y Matthias Holweg, de la Universidad de Oxford, este es el punto central que diferencia el aprendizaje y razonamiento humanos de la inteligencia artificial (IA). En su ensayo académico Theory Is All You Need: AI, Human Cognition, and Causal Reasoning (La teoría es todo lo que necesitas: IA, cognición humana y razonamiento causal, es castellano), publicado a finales de 2024 en la revista académica Strategy Science, los autores califican la generación de lenguaje de la IA como una “predicción basada en datos retrospectiva e imitativa”, mientras que la cognición humana es “prospectiva y se basa en la teoría”.