“Saben escribir, razonar e incluso debatir, pero ¿realmente comprenden lo que dicen? Los grandes modelos de lenguaje, como ChatGPT, ofrecen respuestas coherentes y convincentes que simulan inteligencia, aunque en muchos casos carecen de comprensión genuina. Este fenómeno, que algunos científicos han bautizado como comprensión Potemkin, plantea preguntas inquietantes sobre los límites de la inteligencia artificial y la percepción humana de la racionalidad”. ...

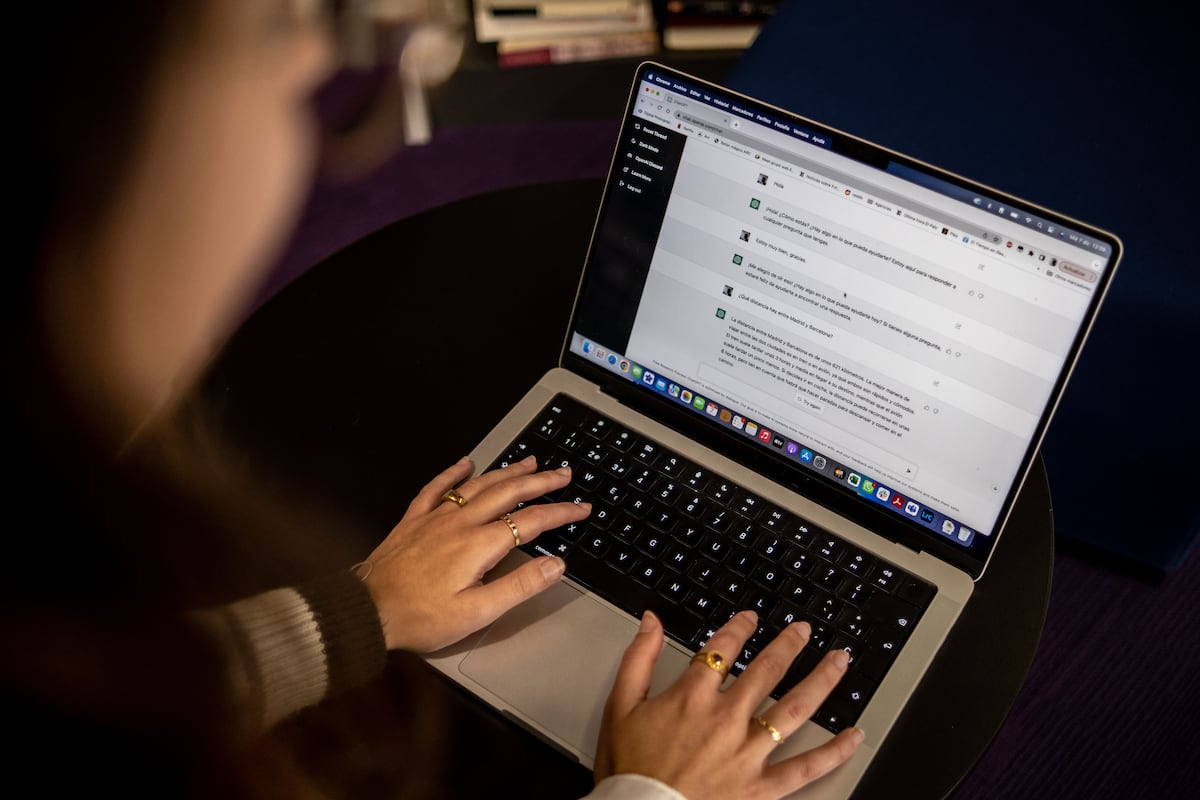

Es tan cierto que esa entradilla ha sido escrita por el propio ChatGPT de Open AI. Nada mal, pero el espejismo se esfumará al final de este reportaje. Los científicos están acumulando evidencia sobre esta aparente racionalidad de los grandes modelos de lenguaje basados en inteligencia artificial. La denominan comprensión Potemkin, loros estocásticos o ilusión de pensamiento. Tonta, vamos. Aunque para algunos, el problema no radica en la IA sino en el usuario. “El error está en pretender que haga cosas para las que no fue diseñada”, opina Daniela Godoy, doctora en Ciencias de la Computación e investigadora del Instituto Superior de Ingeniería del Software en la Universidad Nacional del Centro de la Provincia de Buenos Aires (ISISTAN - UNICEN).