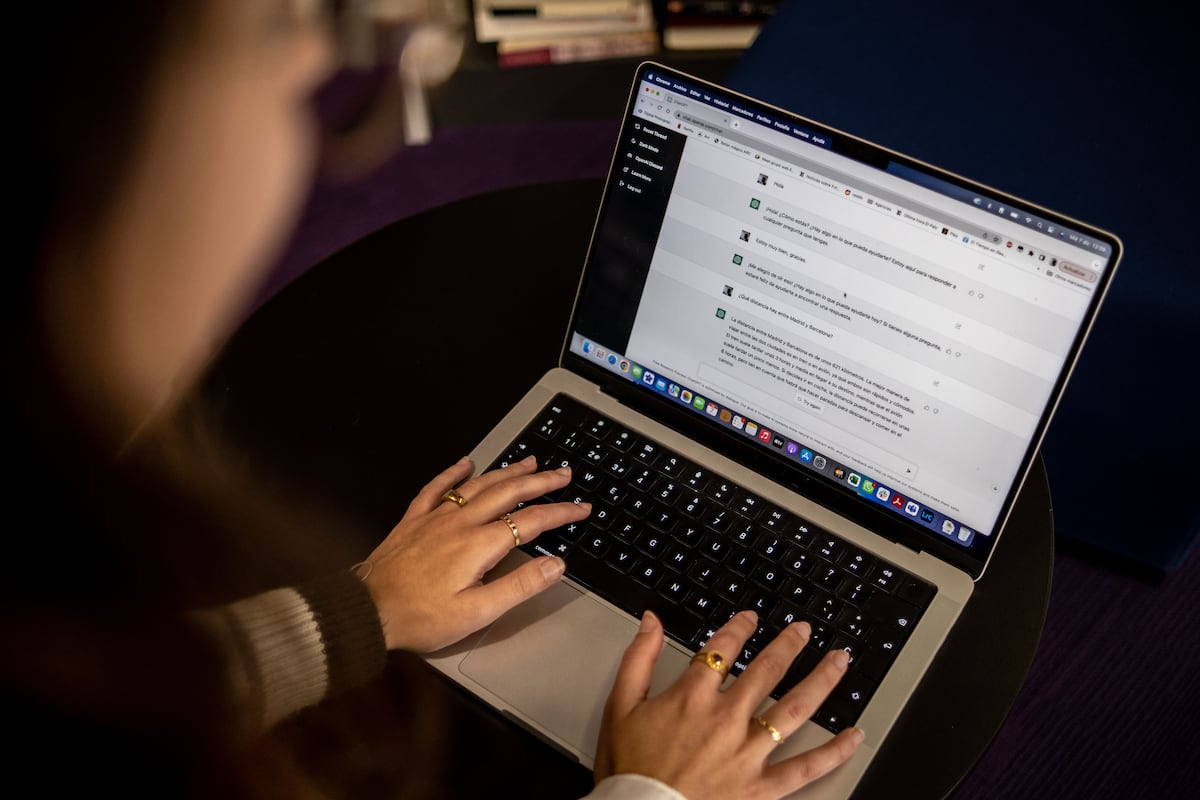

Lo que nos pasa con ChatGPT y los demás modelos grandes de lenguaje es que nos dan la falsa impresión de haber entendido las cosas

Hay una nueva palabra en la literatura técnica que tal vez nos convenga aprender. Es “epistemia”, y significa una ilusión de conocimiento que emerge cuando la verosimilitud sustituye a la verificación. Esto es justo lo que nos pasa con ChatGPT y los demás modelos grandes de lenguaje (large language models, LLM), que

ml" data-link-track-dtm="">nos dan la falsa impresión de haber entendido las cosas. Nos parece que saben cuando solo fingen que saben. O eso creemos, ¿no?, porque un psicólogo conductista podría objetar que, si parece que saben, es que saben. Los conductistas son fans de la caja negra y, por tanto, sostienen que solo podemos saber lo que le metemos a una mente y lo que la mente nos devuelve, el input y el output, la entrada y la salida, pero lo que ocurre dentro del cerebro es una caja negra incognoscible. Esto es una idea anticuada, y ni siquiera era correcta cuando estaba de moda.

Hay una mística de la mente, y esto afecta tanto al cerebro humano como a ChatGPT. En ambos casos podemos decir como el psicólogo conductista que, si parece que saben, es que saben, pero ¿qué queremos decir con eso? Por ejemplo, puedes pensar que Kepler entendió la gravedad, puesto que los planetas que observaba, incluido éste en el que habitamos, giraban en torno al Sol. O puedes pensar que fue Newton quien la entendió, porque descubrió las ecuaciones que rigen esos movimientos. O tal vez fue Einstein, que se dio cuenta de que la materia le dice al espacio cómo curvarse, y de que el espacio le dice a la materia cómo moverse.