Cuando un estudiante puede producir un trabajo con instrucciones a ChatGPT, la pregunta no es si nuestras tareas miden el aprendizaje, es por qué fingimos durante tanto tiempo que lo hacían

Durante años, las universidades hemos recompensado el rendimiento por encima de la comprensión, la fluidez por encima de la profundidad y la apariencia de dominio por encima del pensamiento genuino. Construimos sistemas de evaluación que pedían productos y trataban esos productos como evidencia de aprendizaje. Nos estábamos saliendo con la ...

nuestra. Hasta ahora.

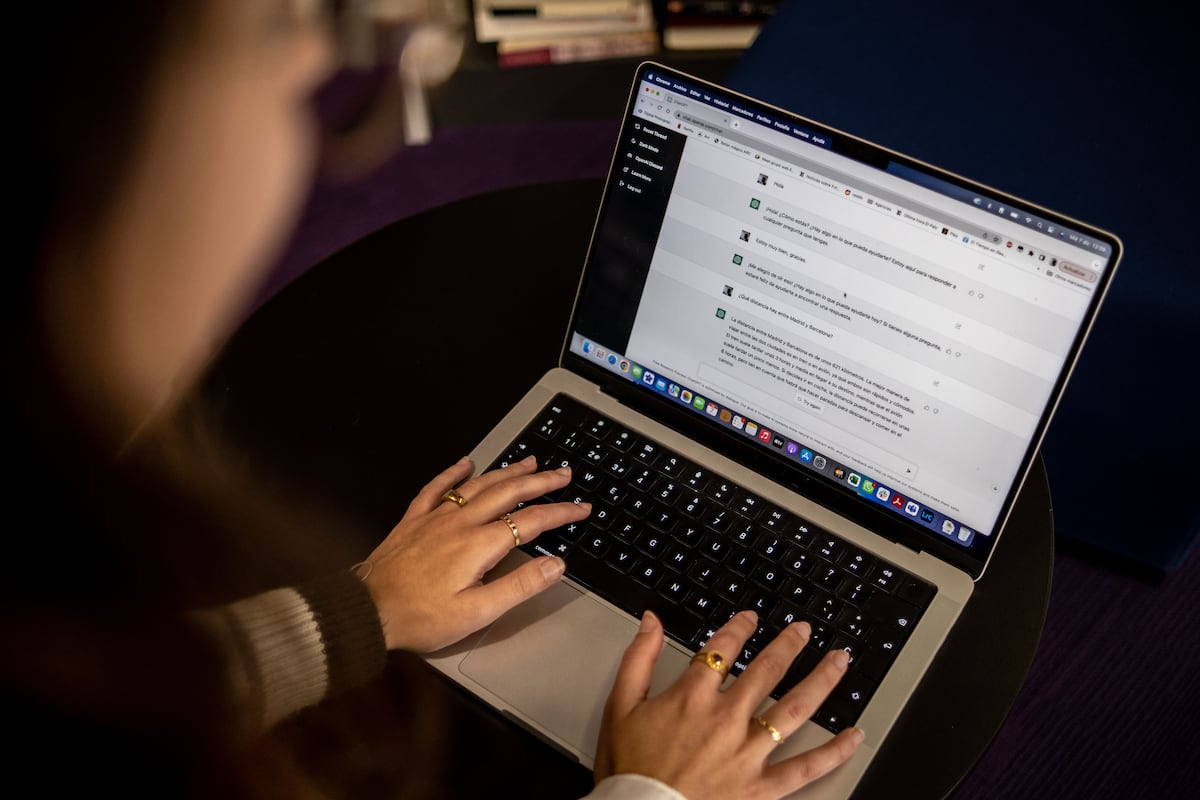

La inteligencia artificial generativa no ha creado un problema nuevo en la educación. Ha hecho que uno muy antiguo sea imposible de ignorar. Cuando un estudiante puede producir un trabajo elaborado en minutos introduciendo unas instrucciones en ChatGPT, la pregunta ya no es si nuestras tareas miden el aprendizaje, es por qué fingimos durante tanto tiempo que lo hacían.

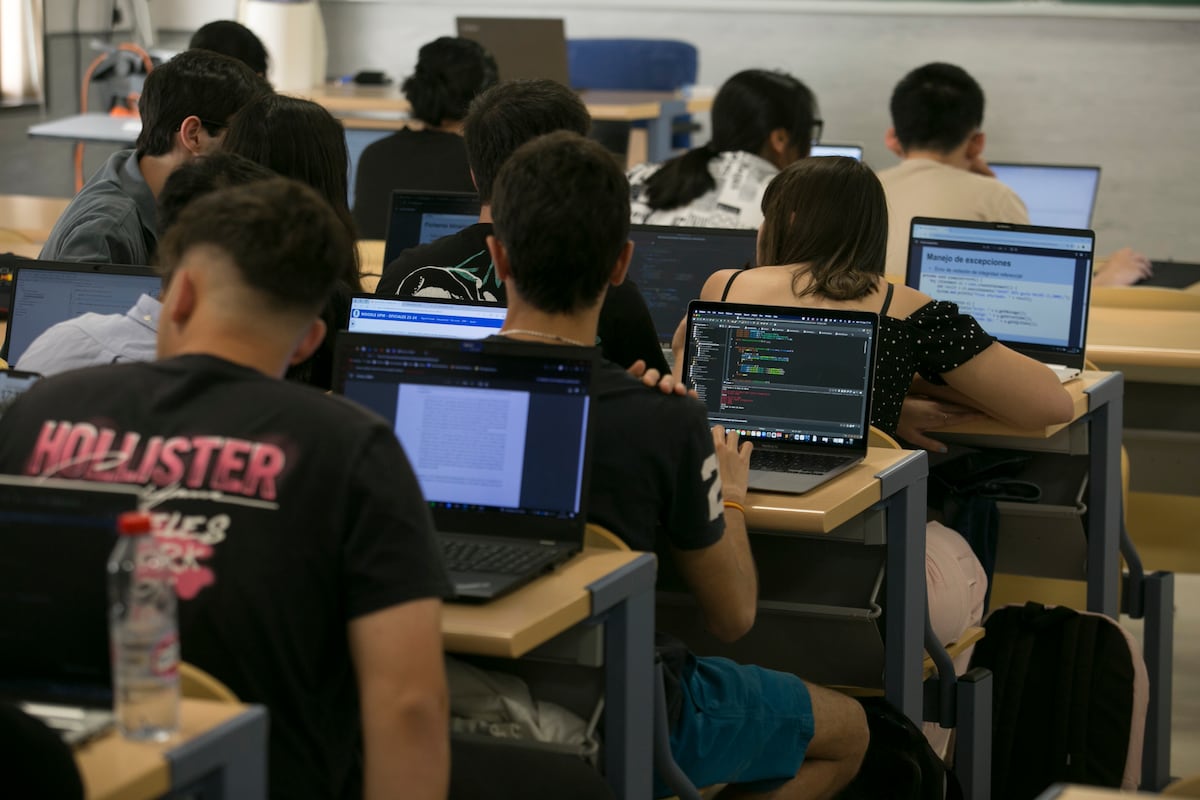

Hay algo de ironía histórica en todo esto. Fue aquí, en Dartmouth (New Hampshire), donde en el verano de 1956 John McCarthy acuñó el término “inteligencia artificial”. 70 años después, los herederos de aquel proyecto de verano producen prosa, redactan código y sintetizan argumentos con una fluidez que puede pasar, a primera vista, por el trabajo de una persona bien formada. El problema no es que a veces se equivoquen. Es que a menudo resultan plausibles.