La notizia è in giro da qualche giorno —risale a un post pubblicato sul blog dell’azienda il 26 agosto 2025 — ma era passata quasi inosservata: OpenAI dichiara candidamente che i propri chatbot controllano le interazioni con gli utenti all’interno di un processo che può concludersi con la segnalazione alle autorità.

Attenzione, però, perché OpenAI limita quest’ultima azione solo se le chat riguardano terze persone. Al contrario, per “rispettare la privacy” dei propri utenti, non informa le autorità dei potenziali casi di autolesionismo limitandosi all’attivazione di una serie di controlli sostanzialmente automatizzati. Più specificamente, nell’ambito della progettazione dei safety-check —i controlli di sicurezza— ChatGPT è stato programmato per fornire risposte amichevoli e non aggressive, oltre che per spingere l’utente a interrompere sessioni troppo lunghe (probabilmente per rompere l’effetto immersivo dell’interazione e consentire alle funzioni razionali di riprendere il controllo della situazione), e per far rinsavire la persona suggerendole di cercare aiuto anche tramite numeri di emergenza e siti internet dedicati.

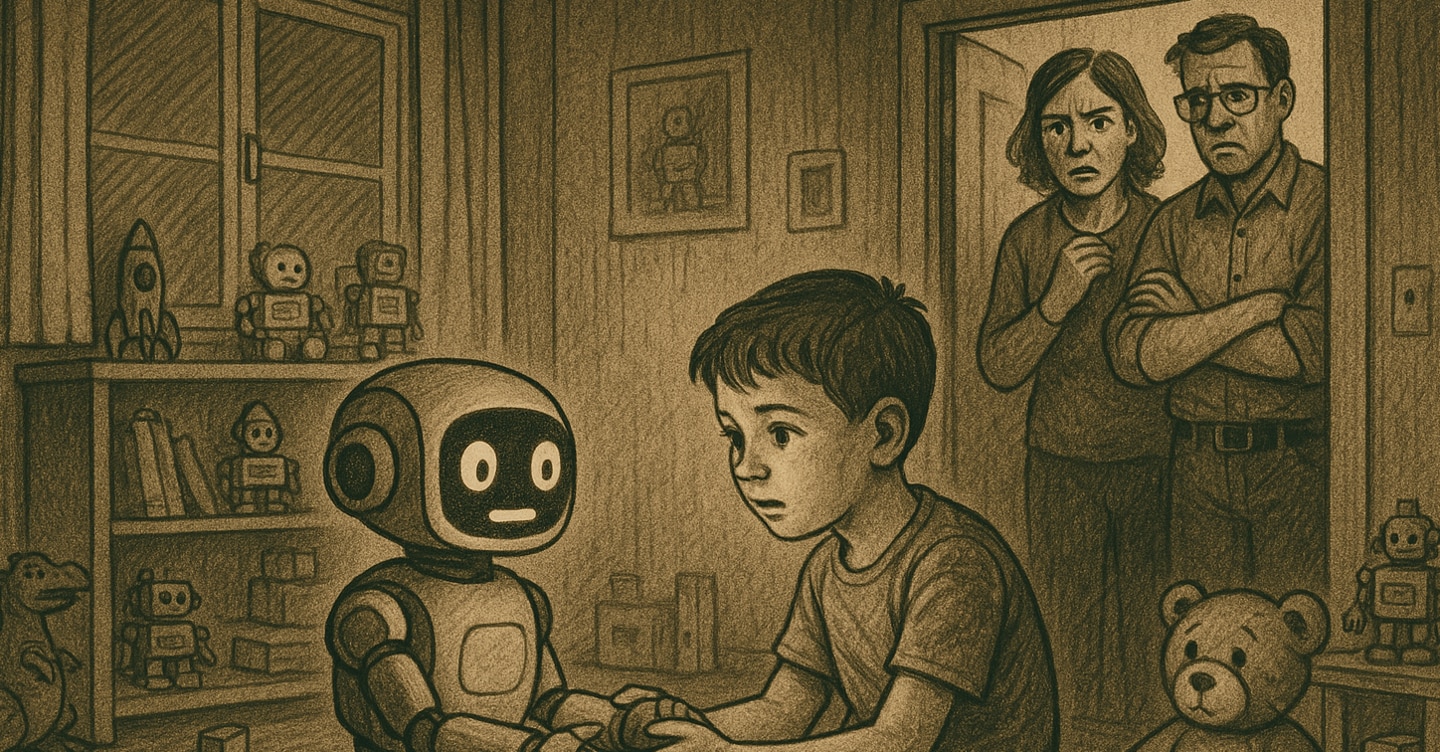

A cosa servono i controlli

L’obiettivo di questo controllo generalizzato, dichiara OpenAI nel post, è quello di essere genuinely helpful —"sinceramente utili.”