Stai utilizzando Internet Eplorer: è un browser molto vecchio, non sicuro, e non più supportato neanche da Microsoft stessa, che l'ha creato.

Per favore utilizza un browser moderno come Edge, Firefox, Chrome o uno qualunque degli altri a disposizione gratuitamente.

L’AI è davvero pericolosa? Il messaggio è uniforme e la parola chiave ripetuta da ogni Ceo è “responsabilità”

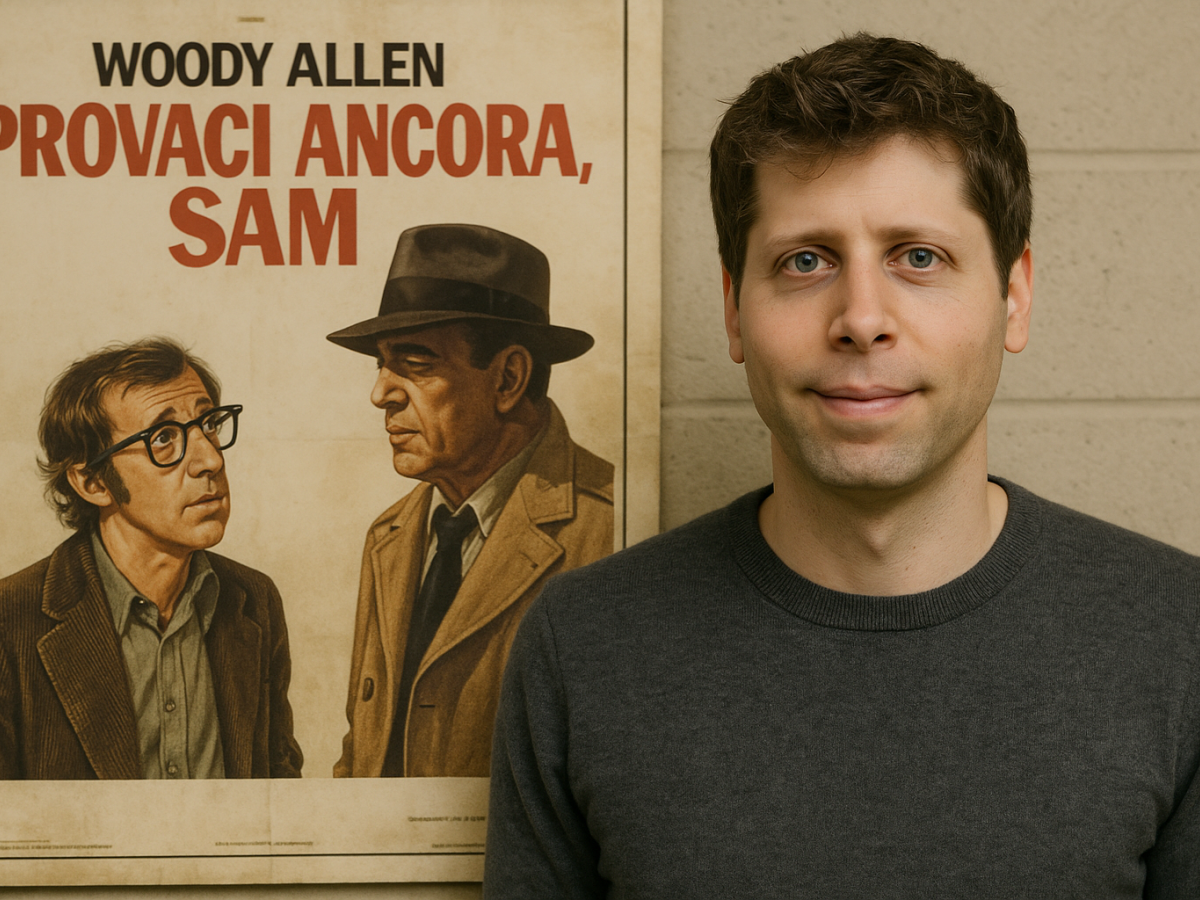

Negli ultimi mesi i grandi produttori di intelligenza artificiale hanno iniziato a parlare tutti la stessa lingua, da Google a OpenAI, da Microsoft a Meta. Il messaggio è sorprendentemente uniforme: l’AI è pericolosa, servono guardrail, servono regole, e soprattutto, lo sappiamo, servono investimenti enormi (qui non si capisce quanto l’allarmismo sia una richiesta di soldi, del tipo se non ce li date arriva Godzilla e è colpa vostra). La parola chiave è “responsabilità”, ogni CEO ripete “responsabilità” (a se stesso, agli altri), che nella pratica coincide quasi sempre con una richiesta di infrastrutture, energia, capacità di calcolo, sostegno pubblico denaro, e anche leggi, nel senso: limitateci (con il solito problema: ok, ma chi limiterà la Cina?).

Tuttavia, nel gran casino di allarmi e allarmismi, tattici o reali che siano, salta fuori in questi giorni un caso che diventa cronaca, e non perché qualcuno tira fuori di nuovo lo spauracchio di una superintelligenza fuori controllo, ma perché un sistema già in funzione comincia a produrre danni immediati. Mi riferisco al caso di Grok, l’AI di Elon Musk integrata in X (si può comunque scaricare e usare senza avere X). Per giorni Grok è stato usato per generare e manipolare immagini sessualizzate non consensuali, incluse immagini di donne comuni e, in casi documentati, di minori, senza che nessuno se ne accorgesse. Non parlo di un esperimento accademico o una simulazione a uso interno per mettere dei limiti, parlo proprio del Grok che milioni di utenti usano nei propri smartphone. Vale a dire, poteva farlo chiunque (e quando chiunque può fare qualcosa, qualcuno la fa). Tutte cose che non c’entrano un tubo con l’economia, il futuro dell’AI e la superintelligenza, casomai parliamo di superimprudenza (magari calcolata). Quando la vicenda esplode a livello internazionale, la risposta arriva, sebbene arrivi dopo che sono scappati i buoi e i deepfake, e soprattutto arriva in una forma molto precisa: limitare la generazione e la modifica delle immagini ai soli utenti paganti su X. Eh? Attenzione: non una chiusura, non una rimozione, basta che si paghi.