Stai utilizzando Internet Eplorer: è un browser molto vecchio, non sicuro, e non più supportato neanche da Microsoft stessa, che l'ha creato.

Per favore utilizza un browser moderno come Edge, Firefox, Chrome o uno qualunque degli altri a disposizione gratuitamente.

OpenAI alza i livelli di allerta e moltiplica le restrizioni, ma gli utenti sperimentano modelli che cambiano senza avviso e falle come il caso Atlas. Tra paura di Google e rigidità crescente, il rischio è “sirizzare” ChatGPT

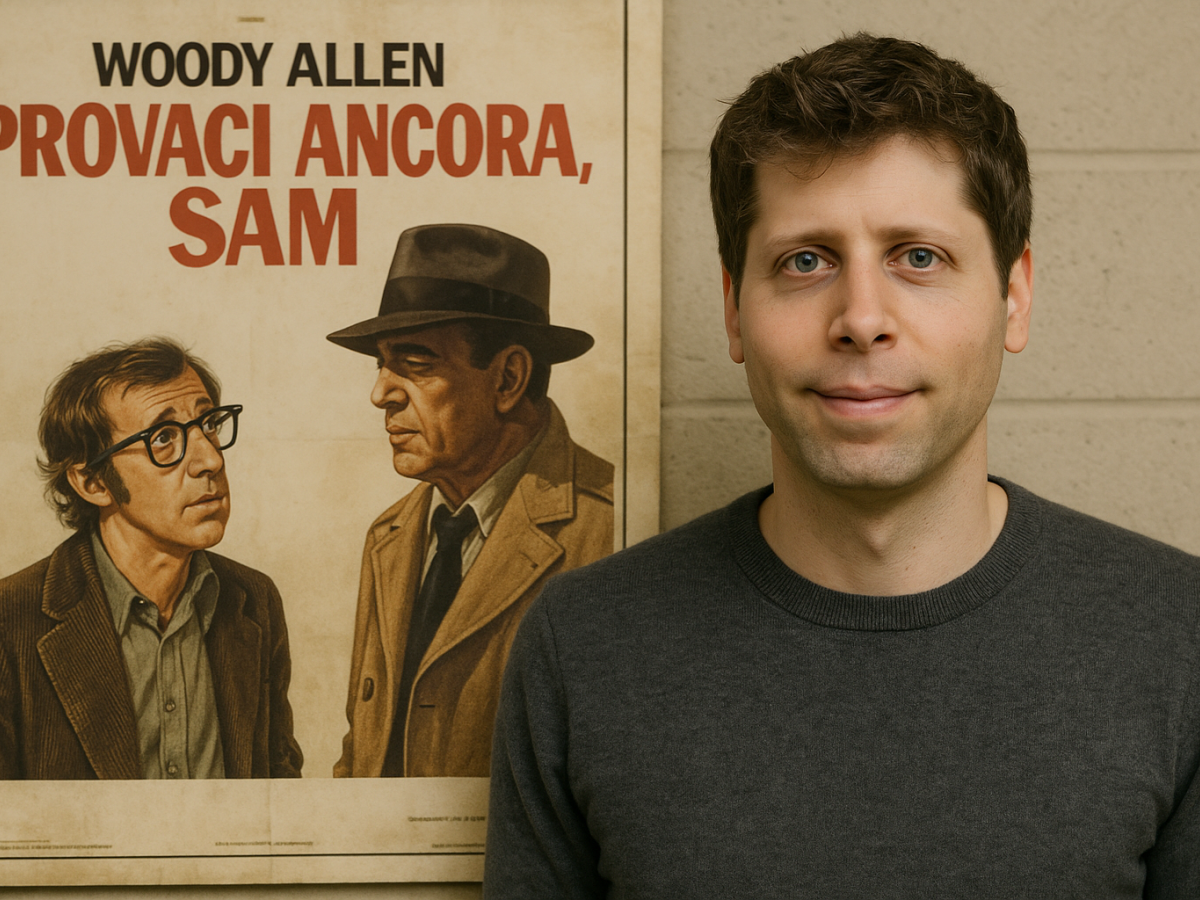

L’ultimo annuncio di OpenAI arriva dopo quello che Sam Altman ha definito un “codice rosso” (a lui piacciono le espressioni da dottor Stranamore, ad agosto scorso ChatGPT5 sarebbe stata “una bomba atomica”, e abbiamo visto com’è andata). Il codice rosso, per capirci, è il momento in cui l’azienda smette di parlare dell’intelligenza artificiale come di una possibilità da esplorare e inizia a trattarla soprattutto come un rischio da contenere, qualcosa che cresce troppo in fretta (purtroppo stanno correndo tutti troppo, da qui il rischio di una bolla finanziaria), e che potrebbe sfuggire di mano se non viene avvolto da strati sempre più fitti di precauzioni. La verità, però, è che la maggiore preoccupazione, in questo momento, si chiama Google. È come la Guerra Fredda: a cosa serviva che le due superpotenze avessero sempre più migliaia di atomiche quando ne sarebbero bastate una ventina per scatenare l’apocalisse? Ragione per cui nessuna l’ha mai usata contro l’altra.