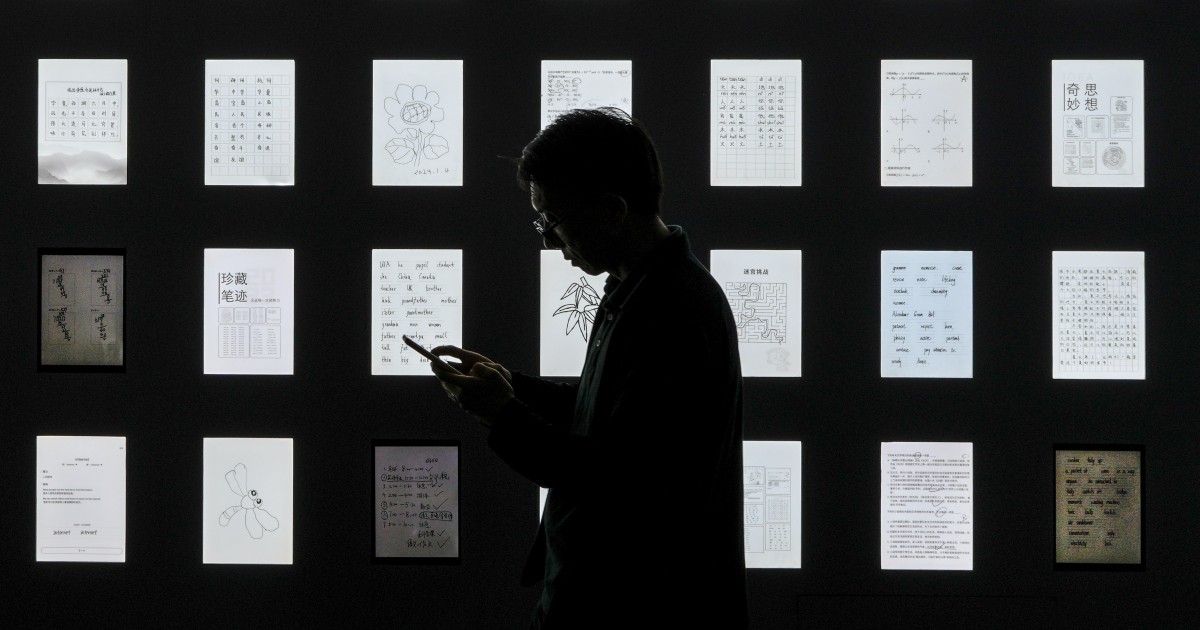

Anche i modelli di intelligenza artificiale soffrono come gli uomini di 'brain rot', il rimbambimento da web, la parola dell'anno 2024 per l'Oxford Dictionary che sta ad indicare un deterioramento intellettuale dovuto al consumo compulsivo di contenuti online di bassa qualità, specialmente quelli che girano sui social.

Lo indica uno studio dell'Università del Texas ad Austin e della Purdue University che ha condotto un esperimento su due modelli linguistici di grandi dimensioni 'open source', Llama di Meta e Qwen della cinese Alibaba.

"Viviamo in un'epoca in cui le informazioni crescono più velocemente dell'attenzione e gran parte di queste sono progettate per catturare clic non per trasmettere profondità. Ci siamo chiesti cosa succede quando le IA vengono addestrate su contenuti spazzatura", afferma Junyuan Hong, professore presso l'Università Nazionale di Singapore che ha collaborato alla ricerca.

Per questo Hong e i suoi colleghi hanno inserito diversi tipi di testo nei modelli linguistici di grandi dimensioni di Meta e Alibaba e hanno esaminato cosa accadeva quando venivano alimentate con post che contenevano espressioni acchiappa clic o di tipo sensazionalistico come "wow", "guarda" o "solo oggi".