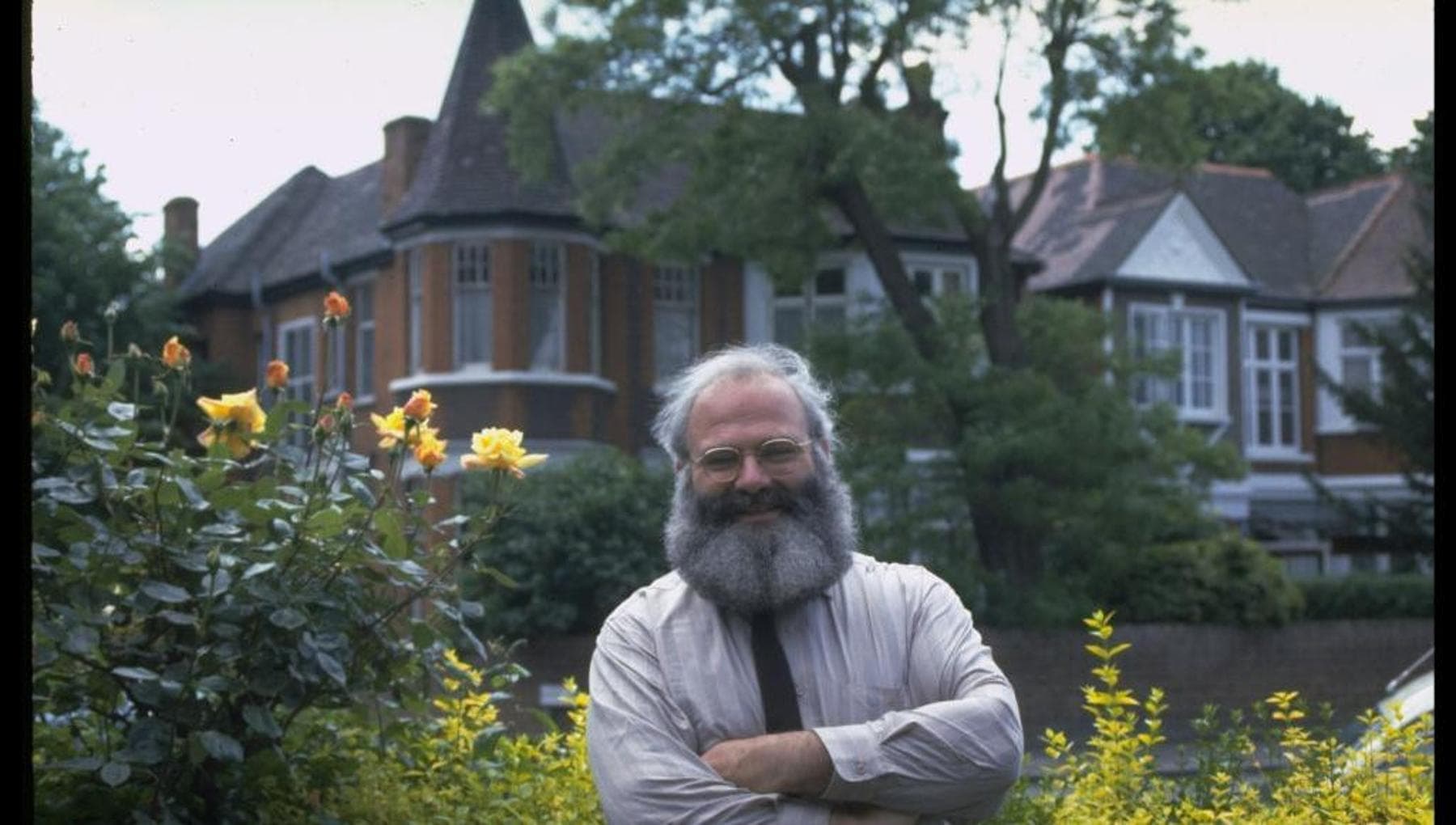

Nel 1974, il neurologo Oliver Sacks iniziò a pubblicare i suoi casi clinici straordinari: pazienti con condizioni neurologiche che il sistema medico trattava come deficit, e che lui leggeva invece come modi diversi di essere nel mondo, con le loro perdite ma anche con capacità che la cognizione ordinaria non possedeva. Ci vollero vent’anni prima che quella prospettiva diventasse un movimento culturale riconoscibile, quello che oggi chiamiamo neurodiversità. Ci vollero altri vent’anni prima che le grandi aziende tecnologiche iniziassero a domandarsi se non stessero sistematicamente escludendo dai loro processi di selezione esattamente le persone di cui avrebbero avuto più bisogno. Oggi, mentre i sistemi di intelligenza artificiale ridefiniscono cosa significa elaborare informazioni complesse, quella domanda torna con una forza nuova e una direzione inaspettata: le architetture che stiamo costruendo somigliano, in qualche misura strutturale, ad alcune forme di cognizione che abbiamo a lungo considerato marginali?

Una convergenza strutturale, non un’analogia superficiale

È necessario chiarire subito cosa si intende e cosa non si intende con questa domanda. L’intelligenza artificiale è un sistema matematico-statistico: non ha esperienza, non ha intenzionalità, non ha una dimensione emotiva e relazionale. La neurodivergenza è una variazione della cognizione umana, vissuta da persone reali con storie reali, con le complessità e le sfide che questo comporta. Equiparare le due cose sarebbe non solo impreciso ma offensivo. La domanda è più sottile: alcune architetture dell’IA mostrano caratteristiche funzionali che, se osservate in un essere umano, sarebbero associate a stili cognitivi neurodivergenti. Non perché l’IA sia neurodivergente, ma perché quelle caratteristiche funzionali, che il pensiero neurotipico dominante ha a lungo considerato secondarie o problematiche, si rivelano particolarmente adatte all'elaborazione di sistemi complessi.