Il futuro della sicurezza nazionale americana è diventato il terreno di scontro tra i nuovi giganti della Silicon Valley e i vertici militari di Washington.

Al centro della disputa c’è Claude, il modello linguistico di Anthropic, e una domanda ipotetica che ha gelato i rapporti tra le parti: l’intelligenza artificiale può avere l’ultima parola in un attacco nucleare?

L’ipotesi di un attacco nucleare che ha messo alle corde Anthropic

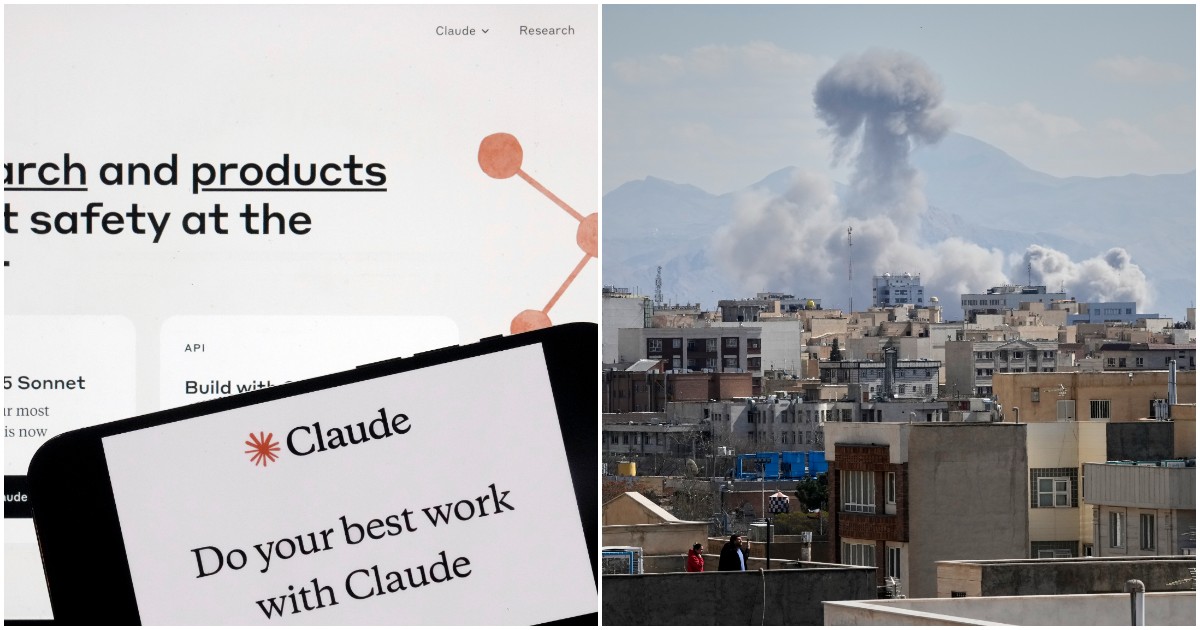

Secondo una ricostruzione esclusiva pubblicata dal Washington Post, il punto di rottura definitivo tra Anthropic e il Dipartimento della Difesa americano - ribattezzato da Trump in “Dipartimento della Guerra” - risalirebbe a un incontro riservato avvenuto lo scorso dicembre.

Durante la riunione, il Sottosegretario alla Guerra per la Ricerca e l'Ingegneria, Emil Michael, avrebbe sottoposto a Dario Amodei, CEO di Anthropic, uno scenario di crisi nazionale estrema: un attacco imminente di missili balistici diretti verso il suolo statunitense. Michael intendeva verificare se, in una situazione in cui i tempi di reazione umani risultano insufficienti, l’azienda avrebbe permesso ai propri modelli di intelligenza artificiale di assumere il controllo dei sistemi difensivi per neutralizzare la minaccia.