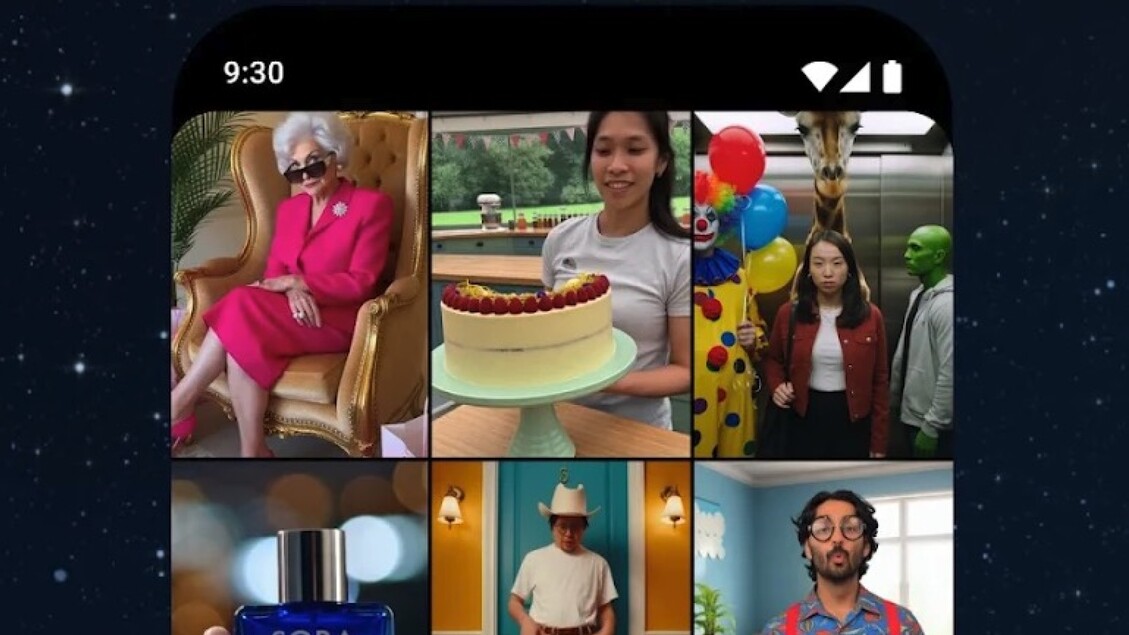

C’è un momento in cui smetti di guardare un video e inizi a crederci. Con Sora, la distanza tra ciò che appare e ciò che è reale si riduce al minimo; distinguere tra realtà e finzione diventa un’impresa. Annunciato nel 2024, il sistema di IA generativa per i video di OpenAI ci ha fatto capire in fretta quanto sia diventato semplice produrre clip ultra-realistiche partendo da un prompt o da un’immagine. Un gioco di prestigio fatto di pixel e probabilità, così convincente da far passare la finzione per realtà agli occhi delle persone. Quello che non avevamo ancora capito, però, è che Sora riesce a confondere anche l’intelligenza artificiale stessa.

A confermare che non si tratta unicamente di un limite della percezione umana, c’è un test di NewsGuard: secondo i risultati, tre tra i chatbot più noti, ossia Grok di xAI, ChatGPT di OpenAI e Gemini di Google, faticano a riconoscere i video generati da Sora. La difficoltà cresce soprattutto quando manca un segnale esplicito come il watermark: un piccolo logo con la scritta “Sora” che si muove durante il video, segnalando l’origine artificiale delle immagini. OpenAI lo applica a tutti i contenuti generati con Sora, ma può essere rimosso facilmente usando tool gratuiti scaricabili online.