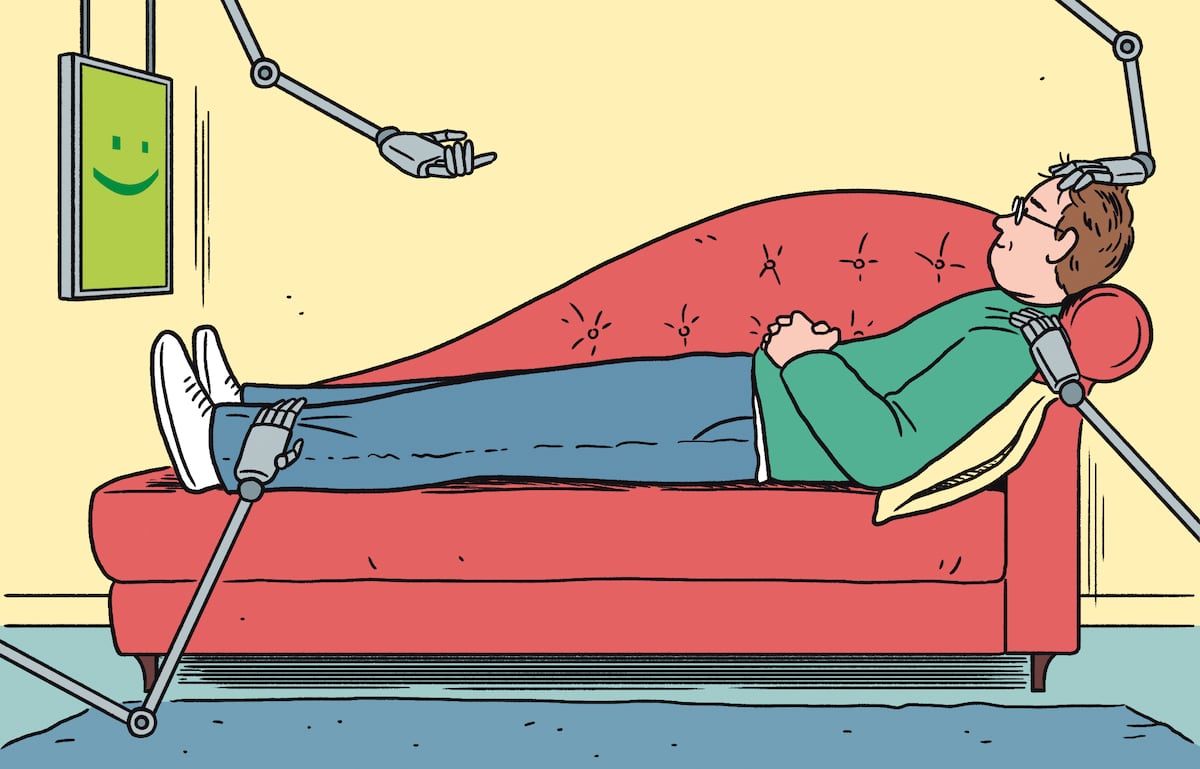

Los bots de inteligencia artificial pueden aliviar la soledad, pero también aislar y generar dependencia. OpenAI reconoce millones de consultas sobre suicidios en ChatGPT

Desde asistentes virtuales capaces de detectar tristeza en la voz hasta bots diseñados para simular el calor de un vínculo afectivo, la inteligencia artificial (IA) está cruzando una frontera más íntima. El fervor que despierta la IA avanza sobre un colchón cada vez más denso de preguntas que nadie termina de responder.

ar-de-cientificos-y-dirigentes-piden-en-la-onu-lineas-rojas-que-eviten-los-riesgos-inaceptables-de-la-ia.html" target="_blank" rel="" title="https://elpais.com/tecnologia/2025-09-22/mas-de-un-centenar-de-cientificos-y-dirigentes-piden-en-la-onu-lineas-rojas-que-eviten-los-riesgos-inaceptables-de-la-ia.html" data-link-track-dtm="">Y pese a que tiene el potencial de reducir la burocracia o predecir enfermedades, los grandes modelos de lenguaje (LLM, por sus siglas en inglés) que son entrenados con datos en múltiples formatos —texto, imagen y voz— están siendo capaces de algo más inquietante: pueden comportarse como si comprendieran los sentimientos humanos.

La percepción y lectura de emociones es un terreno resbaladizo para la IA. Diversos estudios señalan que los chats de IA pueden aliviar la soledad, pero también aislar y generar dependencia. Un caso extremo es el de Stein-Erik Soelberg, de 56 años, que acabó matando a su madre y suicidándose tras largos meses de charla con ChatGPT. Anoche, la compañía OpenAI reconoció que más de un millón de personas hablan con ChatGPT sobre el suicidio cada semana.