En enero, la empresa de capital riesgo Andreessen Horowitz anunció su respaldo a Slingshot AI, el primer modelo fundacional del mundo para psicología, elevando el capital total de la startup a 40 millones de dólares. Unas semanas más tarde entró en vigor la ley de IA de la Unión Europea, que incluye la prohibición de los sistemas de inteligencia artificial manipulativos.

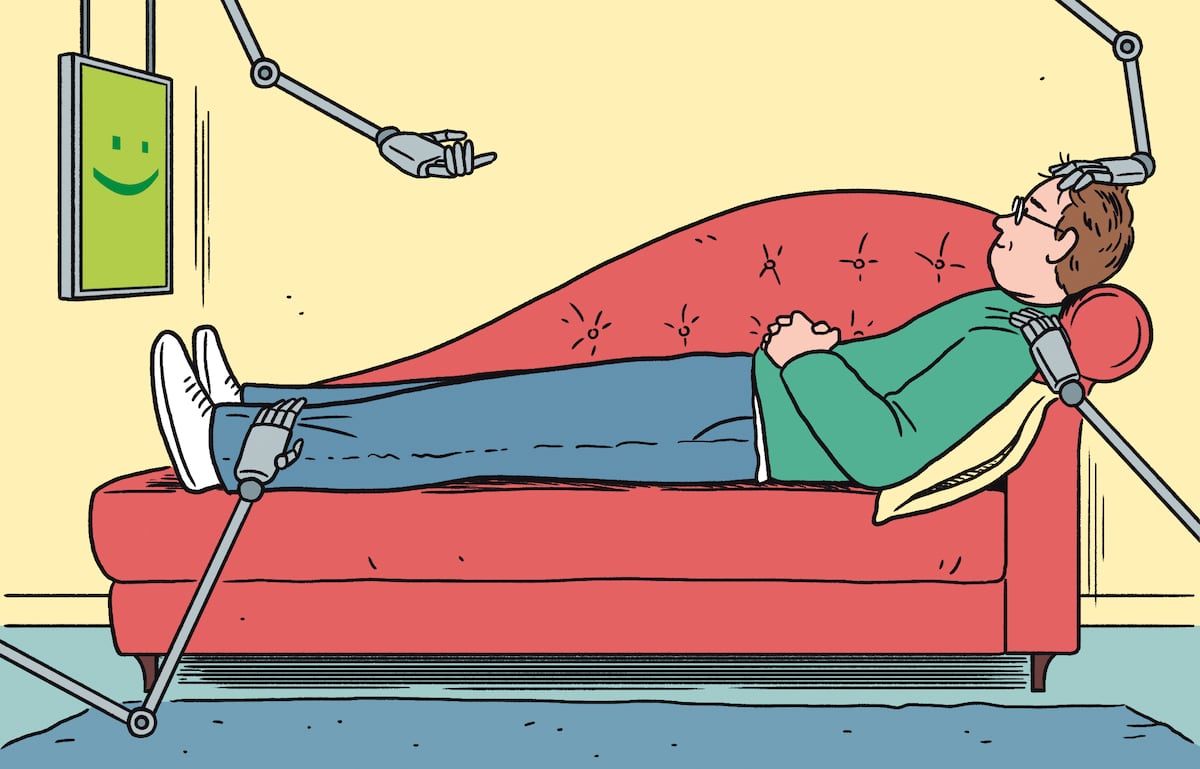

Estos dos acontecimientos ponen de relieve una contradicción preocupante. Incluso mientras los reguladores intentan proteger a los usuarios de prácticas engañosas de esta tecnología, los inversores apuestan a que los chatbots puedan tratar a personas con problemas de salud mental —es decir, cuando son especialmente vulnerables a la explotación—. Peor aún, la forma en que se entrenan actualmente los grandes modelos lingüísticos podría hacer que resultaran básicamente incapaces de brindar este tipo de tratamiento.

El mercado de la salud mental es enorme y el uso de la inteligencia artificial generativa está a punto de expandirse significativamente. El Instituto Nacional de Salud Mental de Estados Unidos estima que uno de cada cinco adultos estadounidenses padece una enfermedad mental. Sin embargo, más de 122 millones de personas del país viven en zonas donde no hay suficientes profesionales de la salud mental. Esto ha dado lugar a una serie de chatbots de IA que prometen cubrir ese vacío. Wysa, por ejemplo, se autodefine como la “alternativa clínica a ChatGPT” y afirma haber ayudado a seis millones de personas en 95 países.