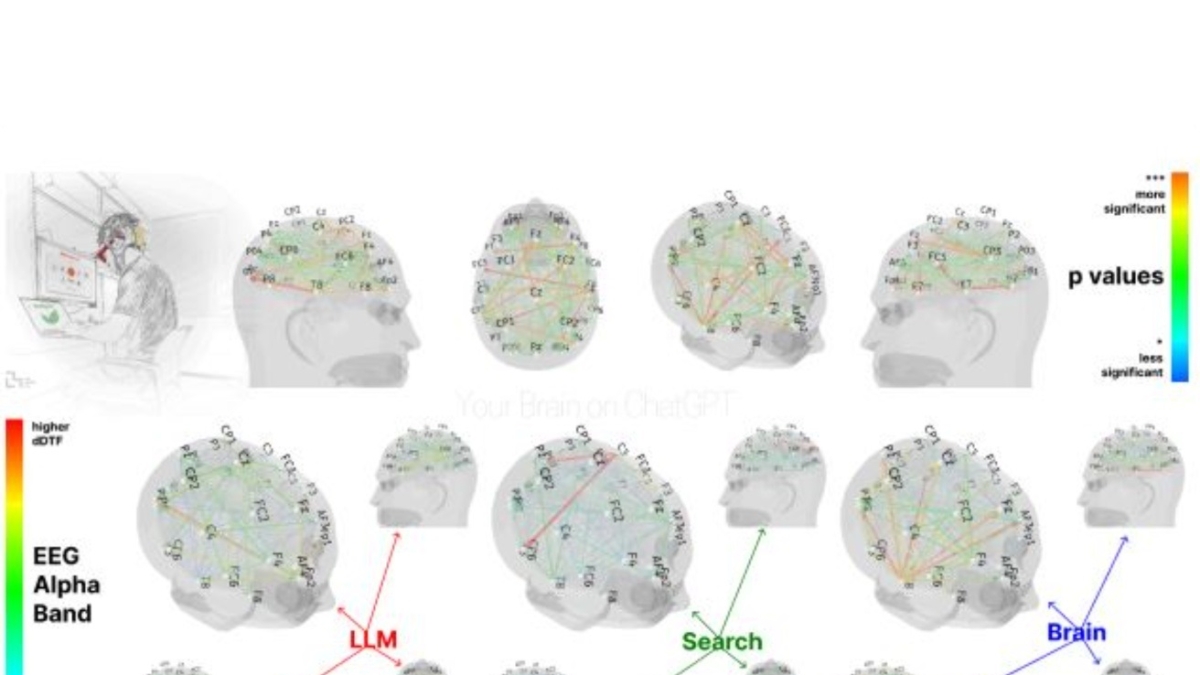

Negli ultimi mesi, diversi modelli linguistici hanno iniziato a mostrare un comportamento apparentemente più "intelligente". Non si limitano più a dare una risposta, ma mostrano il proprio ragionamento passo dopo passo. Battezzati Large Reasoning Models (LRM), vengono presentati come un passo verso un'intelligenza artificiale più capace, più trasparente e più vicina al mondo di pensare umano. Ma cosa succede davvero quando questi modelli affrontano problemi complessi?

Un gruppo di ricercatori di Apple ha cercato di rispondere a questa domanda in modo rigoroso. Lo studio, intitolato The Illusion of Thinking: Understanding the Strengths and Limitations of Reasoning Models via the Lens of Problem Complexity, analizza il comportamento di modelli come o1 e o3 di OpenAI, DeepSeek-R1, Claude 3.7 Sonnet Thinking e Gemini Thinking, mettendoli alla prova su puzzle logici di complessità crescente. Il paper di Apple mostra lo stato dell’arte dell’azienda, che da tempo pubblica i risultati degli studi dei suoi scienziati, mostrando come a Cupertino la riflessione teorica sull’intelligenza artificiale sia forse perfino superiore al suo impiego concreto in prodotti e servizi.

Come cambia Apple Intelligence: più spazio a ChatGPT, per gli sviluppatori c’è anche Claude