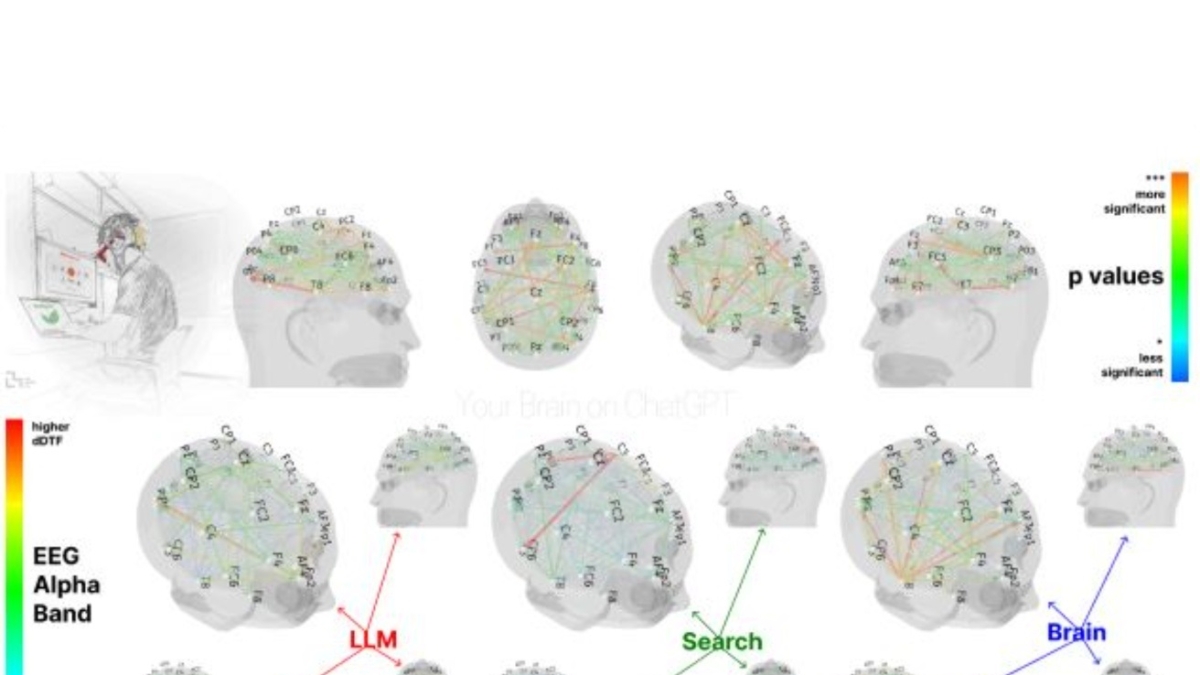

C’è una premessa non detta, ma largamente accettata nel dibattito attuale sull’intelligenza artificiale: che i modelli generativi — in particolare i Large Language Models (LLM) — rappresentino una forma emergente di intelligenza, ancora imperfetta ma inevitabilmente destinata a migliorare. Questa narrazione ha un potente effetto: proietta nel futuro l’idea che presto potremo delegare interi processi cognitivi a sistemi artificiali, con impatti strutturali sul lavoro, sulla conoscenza e sulla società. Ma è proprio qui che si gioca l’equivoco. Perché non stiamo parlando di intelligenza. Stiamo parlando di linguaggio.

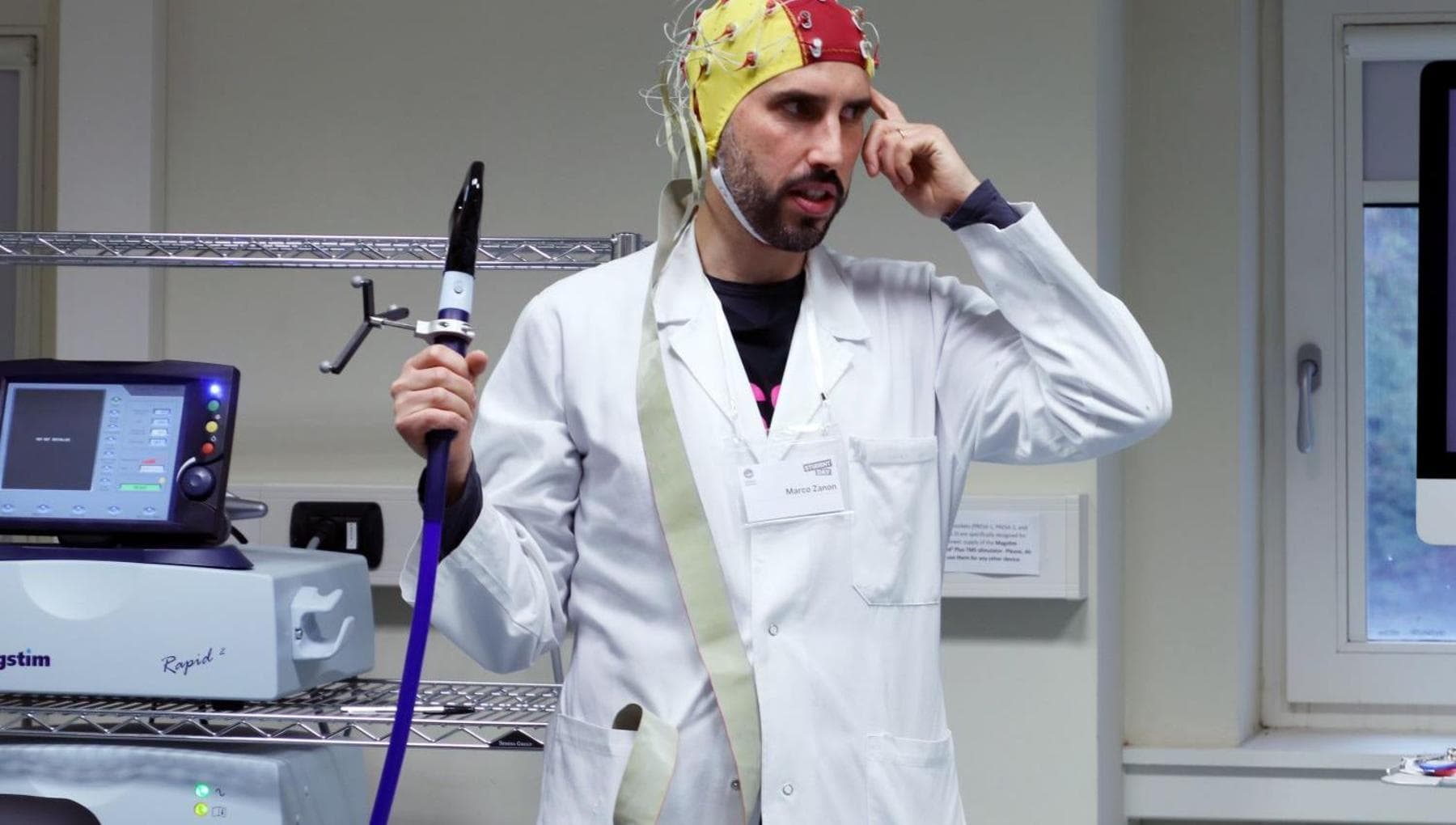

«L'AI non è davvero intelligente, è una questione di statistica. Le allucinazioni? Inevitabili, è una caratteristica intrinseca»

I Large Language Models simulano coerenza, ma non producono conoscenza: l'affidabilità è un limite strutturale e l'automazione non è possibile. «È un'illusione poter delegare senza supervisionare»