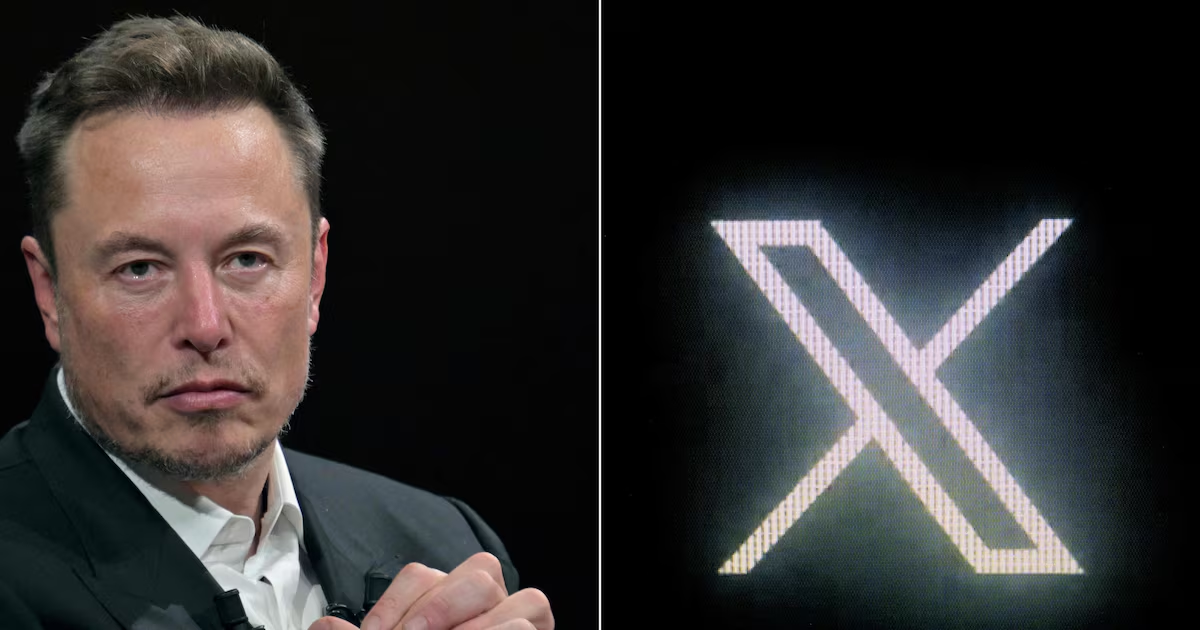

Na semana passada, Elon Musk subiu ao banco das testemunhas no processo que ele move contra a OpenAI. O advogado da defesa fez uma pergunta direta: se a xAI havia usado modelos da OpenAI para treinar o Grok por meio de uma técnica chamada destilação.PUBLICIDADEMusk hesitou, disse que todas as empresas de IA fazem isso. Quando foi pressionado para responder objetivamente, admitiu que sim, “em parte”. O homem que processava a OpenAI por traição à missão original da empresa acabava de confessar que destilou os modelos que processa.A ironia da cena tem um peso adicional. Em fevereiro deste ano, a Anthropic acusou três laboratórios chineses de criarem cerca de 24 mil contas fraudulentas para gerar mais de 16 milhões de trocas com o Claude, num esforço sistemático de destilação. A OpenAI já havia feito acusações semelhantes contra a DeepSeek desde o começo de 2025.Leia outras colunas de Alexandre ChiavegattoRichard Dawkins, o ateu mais famoso do mundo, acha que a inteligência artificial tem almaRadiologia e programação: as profissões que a IA deveria substituir estão em altaVale entender o que de fato é a destilação, porque o nome é sugestivo e, ao mesmo tempo, enganoso. Pense numa professora experiente de cardiologia ensinando um residente. A professora passou décadas vendo casos clínicos, errando diagnósticos e refinando suas intuições. O residente não precisa repetir essa trajetória inteira para se tornar competente.PublicidadeEle observa a professora diante de um exame e presta atenção em como a professora pondera as hipóteses, o que ela descarta rapidamente e onde ela hesita. Em pouco tempo, o residente consegue chegar a diagnósticos parecidos sem ter precisado viver tudo aquilo. Foi destilado nele um conhecimento que custaria décadas para ser construído a partir do zero.A destilação faz isso com modelos de linguagem. Comprime o resultado de uma jornada complexa numa transmissão rápida e barata. Um modelo grande, treinado com infraestrutura bilionária e quantidades absurdas de dados, passa a ensinar a sua próxima versão.Elon Musk processa a OpenAI por traição à missão original da empresa, mas confessou que destilou os modelos que processa Foto: Alain Jocard/AFPPor algum tempo, essa técnica foi vista com desconfiança. Em 2024, um artigo da Nature concluiu que modelos treinados recursivamente em dados gerados por outros modelos sofriam uma degradação acelerada. O termo “model collapse” pegou. Houve uma onda de artigos de opinião profetizando que a internet, contaminada por texto sintético, envenenaria as próximas gerações de IA.A profecia envelheceu mal. Os experimentos originais usaram modelos pequenos, num regime de substituição completa onde cada geração descartava os dados anteriores. Trabalhos posteriores mostraram que, quando dados sintéticos se acumulam junto com dados humanos, em vez de substituí-los, o colapso desaparece.O que aconteceu, na prática, foi o oposto do previsto. A destilação se tornou o método mais eficiente de transferir capacidades de fronteira para modelos menores. O Grok subiu na hierarquia das IAs porque, segundo o próprio Musk, destilou a OpenAI.PublicidadeA inteligência artificial inventou uma forma de hereditariedade que a biologia nunca permitiu. Um modelo de linguagem pode passar o essencial do seu julgamento para um sucessor menor numa questão de semanas, e esse sucessor pode passar para outro, e assim por diante.O que parecia ser o risco apocalíptico de um colapso virou, na prática, a forma como a inteligência se democratiza. Os filhos aprendem rápido demais. Enquanto isso, os pais contam as dívidas de quanto custou cada lição.

Opinião | Lição de mestre: a técnica que permite à inteligência artificial ensinar sua próxima versão

Treinar uma IA copiando outra parecia um atalho para a degradação, mas virou o caminho mais rápido do progresso