"Per noi è stata una tragedia, probabilmente nata da altro, ma sicuramente accelerata, spinta, da algoritmi e navigazioni: in sei mesi è stata come una malattia fulminante e noi eravamo senza armi".

È il racconto di Irene Roggero, madre di una bambina di 12 anni, che si è suicidata nel febbraio 2024, e che assieme al marito e ad un'altra decina di famiglie, affiancate dal Moige-Movimento Italiano Genitori e con lo studio legale Ambrosio & Commodo di Torino, ha presentato una class action "inibitoria" contro Meta, nello specifico Instagram e Facebook, e TikTok.

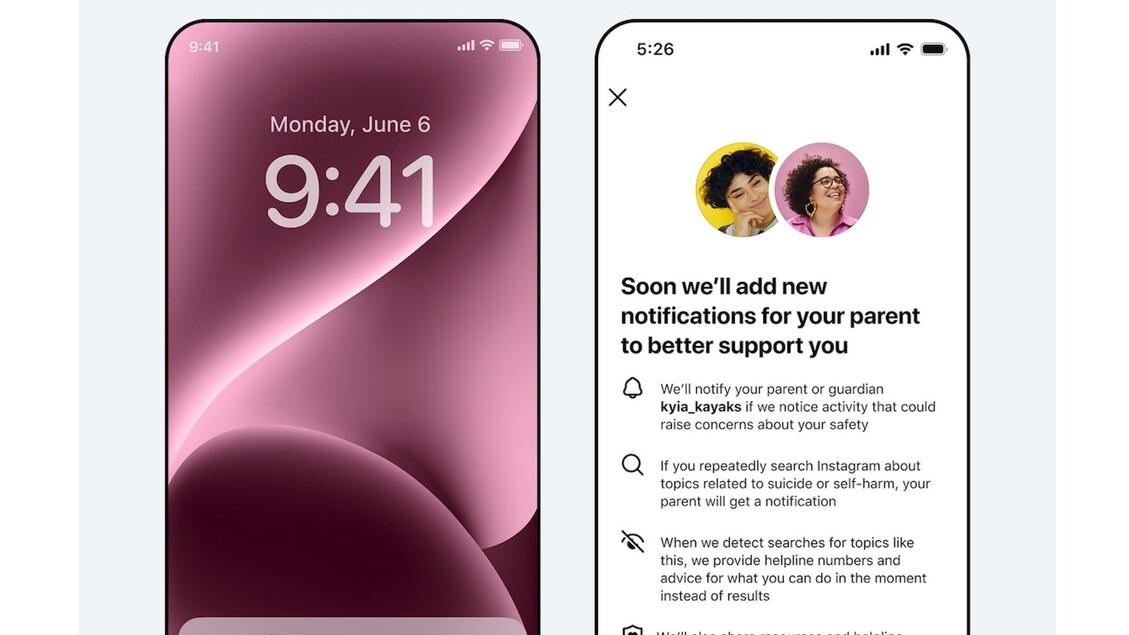

Un ricorso di oltre 150 pagine con il quale hanno chiesto al Tribunale civile di Milano "con urgenza" di sospendere tutti gli account social, fino a che le piattaforme non si adopereranno con mezzi adeguati per controllare effettivamente l'età degli utenti. Si stima, spiegano i legali, che 3,5 milioni di bambini italiani "tra i 7 e i 14 anni siano attivi su Meta e TikTok con dati non verificati o falsi".

Davanti ai giudici della Sezione imprese, presieduta da Angelo Mambriani, si è tenuta la prima udienza del procedimento cautelare, la prima causa in Italia di questo genere. La madre della bambina morta due anni fa ha raccontato ai cronisti che, dopo il dramma, lei e il marito avevano scoperto che "in sei mesi era passata da scrivere del disagio che provava, del fatto di sentirsi un peso, a cercare immagini e contenuti che inneggiavano alla depressione, disegni di ragazzini rotti e senza cuore, immagini tristi e le venivano riproposti di continuo, perché l'algoritmo le dava quello che cercava".