Gli strumenti di rilevamento dell’IA sono spesso oggetto di discussione. Promettono di classificare testi e immagini prodotti da un’intelligenza artificiale con un certo grado di accuratezza, espresso in percentuale. Gli utenti copiano un documento sulle pagine web di questi servizi, oppure caricano delle foto, e una volta premuto “invio” ottengono in risposta un “verdetto”: il contenuto in questione è “umano” o “AI”.

Il problema è che, tecnicamente, non esistono strumenti capaci di individuare con certezza assoluta le tracce dell’IA.

E questo equivoco - la percezione che invece siano in grado di farlo - genera problemi talvolta più grandi dei deepfake stessi.

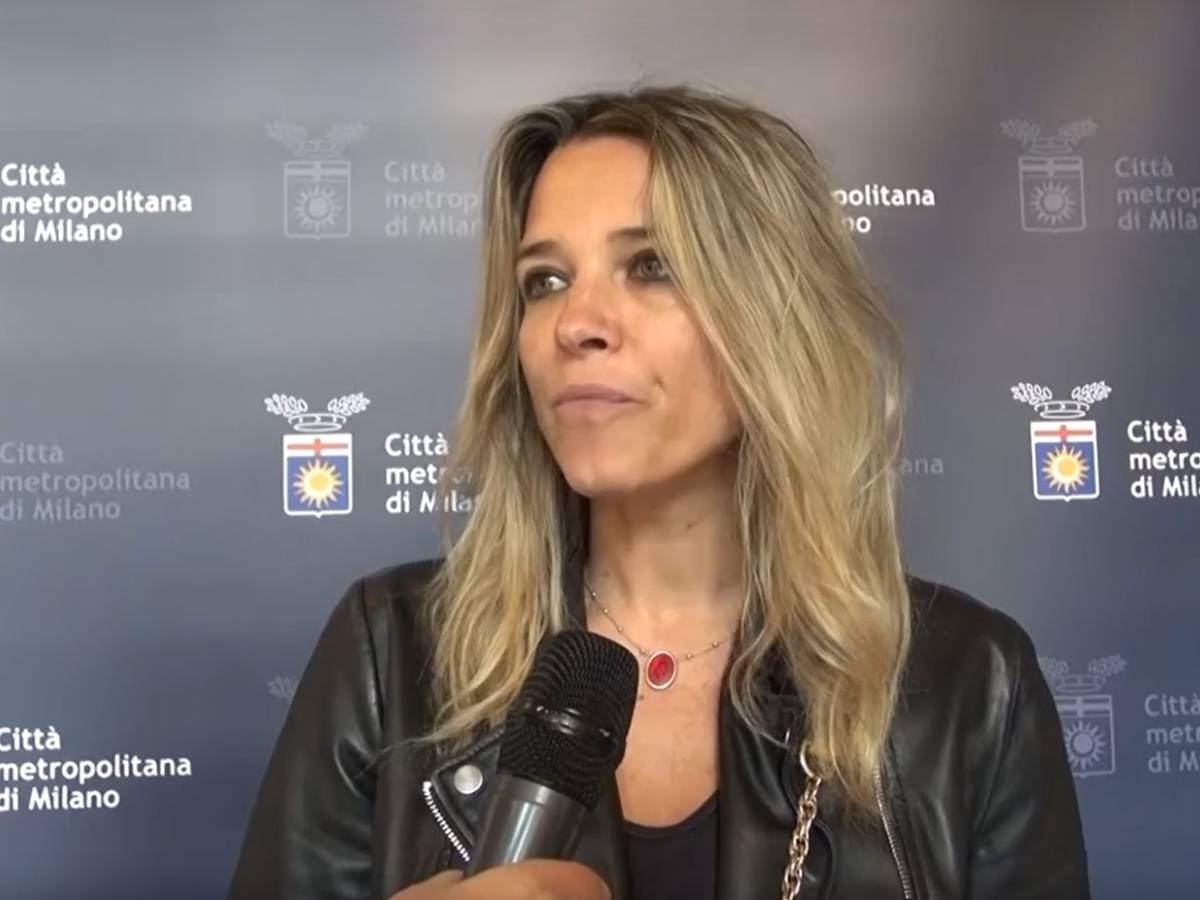

NewsGuard, società statunitense specializzata nel monitoraggio dell’affidabilità delle fonti online e della disinformazione, ha testato cinque tra i principali strumenti utilizzati online per “verificare” immagini potenzialmente create da un’intelligenza artificiale. L’indagine sottolinea una vulnerabilità preoccupante: tre dei cinque strumenti in questione hanno classificato come generate dall’intelligenza artificiale delle immagini che in realtà sono reali. Nel complesso, le immagini autentiche sono state giudicate artificiali nel 13,33% dei casi.