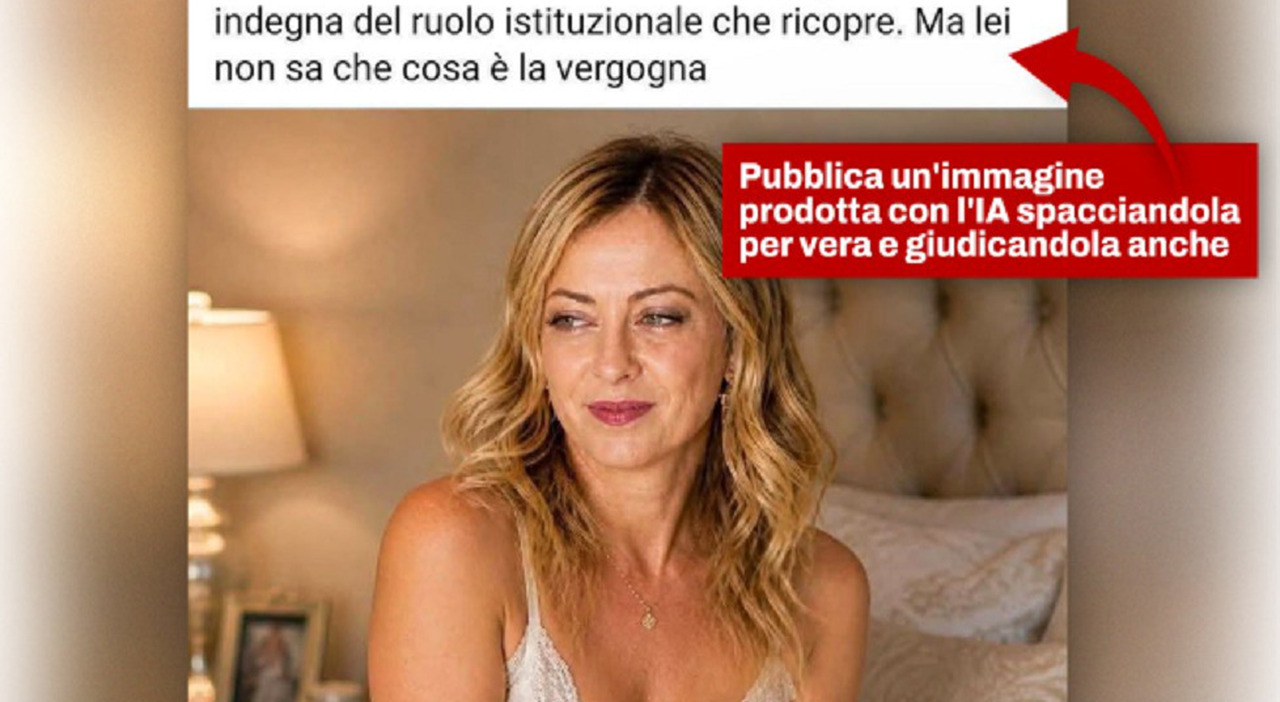

Le immagini deepfake che hanno colpito la presidente del Consiglio Giorgia Meloni stanno già prendendo la strada più pericolosa: quella della normalizzazione. C’è chi minimizza, chi parla di provocazione, chi si rifugia nella solita etichetta rassicurante della “satira”. Ma qui non c’è nulla da alleggerire, perché qui non c’è satira. C’è un corpo che viene preso, manipolato, riscritto senza consenso. E quando accade questo, la tecnologia smette di essere uno strumento e diventa un mezzo di violenza. Non è la prima volta e non sarà l’ultima, ed è proprio questo che dovrebbe inquietarci davvero. Non tanto il fatto in sé, ma la velocità con cui ci stiamo abituando.

Il punto non è che sia successo a una figura pubblica, anzi, è proprio questo che rischia di ingannarci, perché ci permette di pensare che in fondo faccia parte del prezzo della visibilità. È una scorciatoia mentale, comoda e pericolosa. Perché la verità è che oggi basta una fotografia, basta un volto, basta qualcuno che decida di farlo, e la tua immagine può diventare altro da te, qualcosa che non hai mai scelto, mai vissuto, mai autorizzato. Non è più questione di vero o falso. È questione di ciò che resta. Perché anche quando sappiamo che un’immagine è costruita, qualcosa si deposita comunque nello sguardo di chi guarda, nella memoria di chi la incrocia, nel giudizio silenzioso che si forma senza chiedere permesso.