La colaboración entre universidad, empresa y centros tecnológicos pone a prueba la capacidad del sistema para traducir el conocimiento en mejoras concretas frente a problemas reales

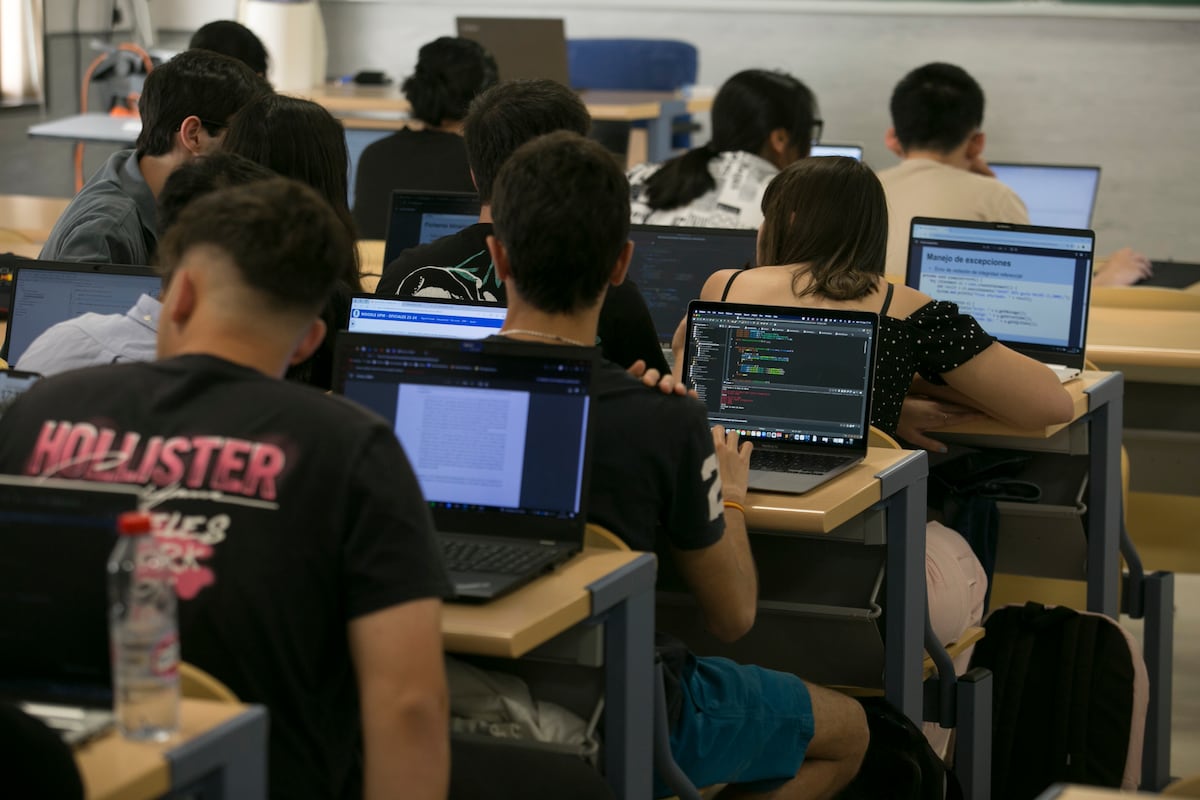

La escena es fácil de imaginar. En una clase universitaria, el profesor activa una herramienta de realidad aumentada y, de pronto, el contenido cobra volumen: gráficos que flotan en el aire, modelos tridimensionales que pueden rotarse con la mano y simulaciones que antes solo existían en una pantalla plana. Los estudiantes se inclinan hacia delante, comentan entre ellos y participan más. La sensación es que algo ha mejorado. Pero, cuando se apagan las luces y se guardan los dispositivos, queda una pregunta que no siempre resulta tan evidente como el entusiasmo inicial: ¿han aprendido más o simplemente han vivido una experiencia más atractiva?

Esa diferencia —la que separa la percepción de la mejora real— es, en esencia, el terreno de la investigación aplicada. No basta con introducir una innovación ni con describir lo que ocurre; hace falta comprobar si el cambio produce efectos comprobables y sostenidos. “La investigación aplicada empieza al intervenir (o simular una intervención) sobre un problema real, para cambiar algo y medir qué pasa después”, explica Fabrizio Salvador, responsable de la nueva cátedra en Excelencia Operativa de IE University. En su trabajo, eso ha implicado diseñar comparaciones rigurosas para evaluar si la realidad aumentada mejora efectivamente el aprendizaje, pero también cruzar cientos de millones de datos en explotaciones agrícolas de India y África para entender qué decisiones aumentan la productividad o analizar cómo la configuración de los equipos en organizaciones complejas influye en sus resultados.