«Una mattina a colazione un collega mi parlava di un lavoro per trovare gatti su internet. Mentre mi chiedevo a chi potesse interessare ho notato che usava 16mila Gpu (unità di elaborazione grafica di un computer, ndr) e ho pensato che si potesse fare con molte meno e così gli assegnai un mio ricercatore, che ci è riuscito con 48».

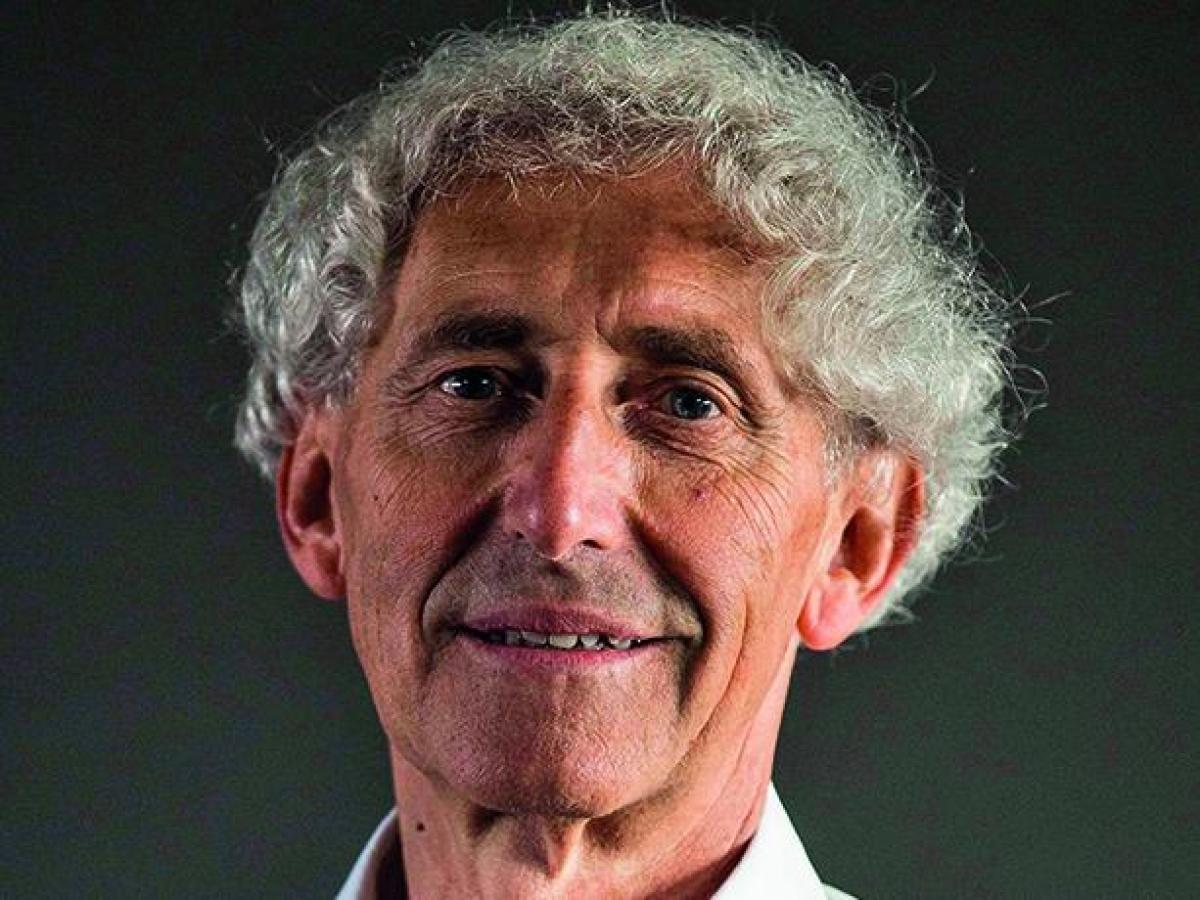

Tra ricerche, calcoli di alta precisione e tecnologia, Bill Dally, chief scientist e vicepresidente senior per la ricerca di Nvidia, inserisce anche questo aneddoto, divertente sì, ma per lui «alla base di quello che si è sviluppato in Nvidia».

Il guru scientifico dell'azienda più capitalizzata al mondo lo ha raccontato come simbolo di necessità di efficienza, nella sala gremita delle Ogr di Torino per la sua lectio magistralis nel programma Csp-Ias – Institute for advanced study, promosso dall'Istituto italiano di intelligenza artificiale per l'industria (AI4I) e dalla Compagnia di San Paolo, co-ideatrice e co-organizzatrice dell'iniziativa.

Al centro della sua lezione l'evoluzione dell'hardware per il deep learning e le trasformazioni necessarie per sostenere modelli e applicazioni su larga scala.

Dally ha sottolineato come la crescita della capacità computazionale di ordini di grandezza ha permesso la sostenibilità dell'attuale intelligenza artificiale. La stessa che, ha ammesso, «noi a Nvidia usiamo tutti i giorni per essere più produttivi».