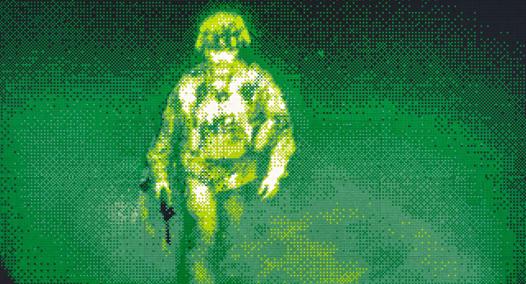

A Gaza si è visto il risvolto più duro e concreto della dirompenza dell’intelligenza artificiale. Scesa in campo, quello di battaglia, al fianco dell’esercito israeliano. Se sappiamo come funzionano Lavender e The Gospel, sistemi che a diverso grado aiutano l’Idf a capire dove lanciare le proprie bombe, è grazie alle inchieste giornalistiche di +972 magazine e Local Call. Da quel momento si è definitivamente aperto il dibattito internazionale sul tema, spesso polarizzato. Da una parte chi pensa che siano necessarie regole specifiche per evitare la deumanizzazione dei conflitti armati, dall’altra chi è convinto che la tecnologia possa risolvere eventuali mancanze o errori dell’essere umano. Davanti a questa complessità è sicuramente auspicabile un dibattito pubblico sempre più informato.

“Vedo grossi rischi in questo utilizzo dell’intelligenza artificiale: l’escalation involontaria ad esempio, ma anche il genocidio automatizzato che stiamo vedendo in questo periodo. Così come un altro fattore importante è l’accessibilità a queste tecnologie in termini di prezzo. Prima erano in mano alla Nato, ora a sempre più attori nel mondo” dice Mark Brakel, direttore policy del Future of Life Institute. Brakel ha avuto un ruolo determinante nella definizione dell’AI Act dell’Unione Europea. Per questo motivo è molto diretto quando parla della mancanza di una regolamentazione delle tecnologie militari: “Nell’AI Act viene detto nella prima frase: il regolamento non vale per quanto riguarda le applicazioni militari. E questo è un problema: non abbiamo ancora mai regolato questo settore”.