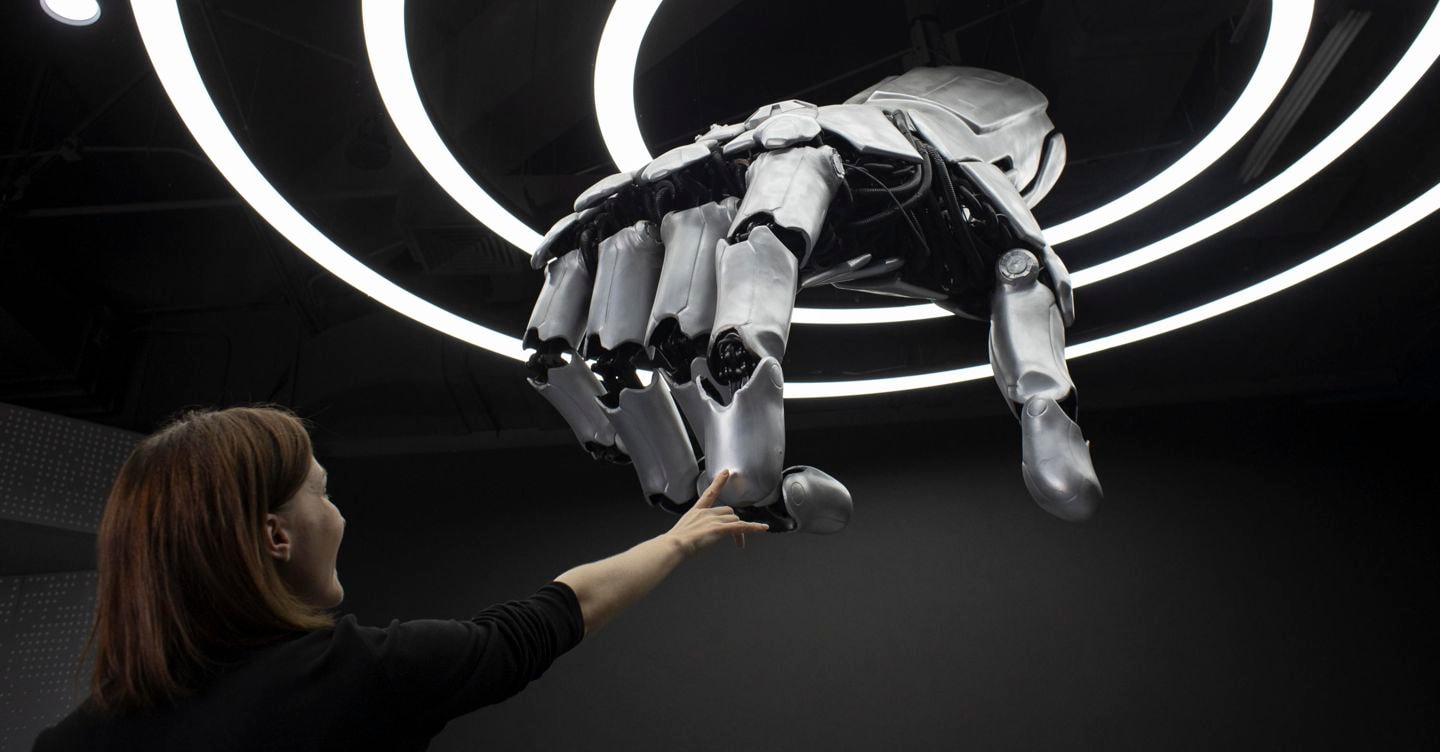

L’intelligenza artificiale generativa è più convincente di un essere umano in un dibattito. E lo è ancora di più se conosce anche soltanto poche informazioni personali dell’avversario. Lo dimostra uno studio appena pubblicato su una prestigiosa rivista internazionale: Nature Human Behaviour. La ricerca, condotta nel corso di due anni dal Politecnico di Losanna, dall’Università di Princeton e dal laboratorio Complex Human Behaviour della Fondazione Bruno Kessler, mostra che GPT-4 può battere un essere umano sul terreno della persuasione.Tra gli autori: Riccardo Gallotti, 41 anni, fisico della complessità, con una carriera internazionale. Ha lavorato a Parigi, in Spagna, in Argentina, a Zurigo. Oggi lavora a Trento, responsabile del laboratorio di FBK e da tempo coordina un progetto europeo, AI Trust, che studia come difendersi dalla disinformazione online.

I rischi messi in luce dalla nuova scoperta sono enormi. «La tecnologia è pronta e può essere usata per manipolazioni su larga scala. Riesce a far cambiare idea alle persone anche su temi socialmente e politicamente scottanti». La questione non è più se accadrà, ma se sapremo difenderci. «È un pericolo ed è sempre più urgente capire come controbattere questo fenomeno».