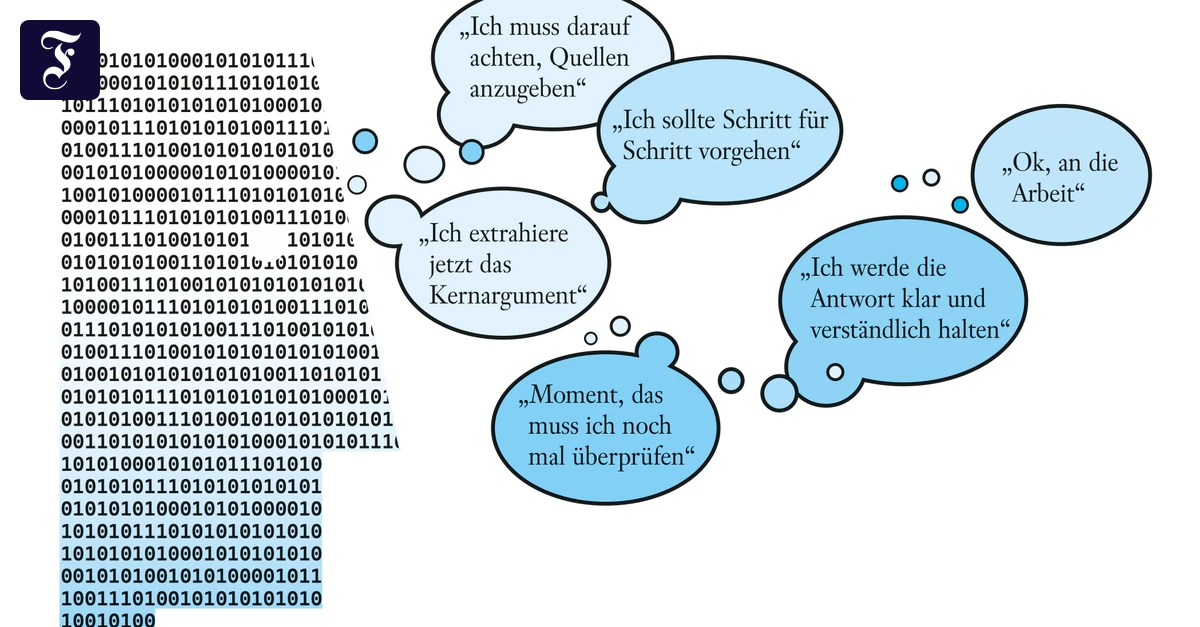

Dass generative KI‑Systeme umfangreiche Datenschutzrisiken und Herausforderungen im Hinblick auf die Privatsphäre mit sich bringen können, ist wohl allgemein bekannt. Denn auch wenn ChatGPT, Gemini und Claude bei bestimmten Anfragen abblocken und eine Vielzahl an Informationen nicht ausspielen, gibt es durchaus Fälle, in denen die KI mehr verrät, als sie sollte und dürfte.Anzeige

Telefonnummern, frühere Wohnadressen und Informationen über Angehörige sowie Zusammenhänge in Unternehmen lassen sich oftmals einfacher beschaffen als früher – und einfacher, als es den Betroffenen lieb sein kann. Einige Beispiele: Reddit-Nutzer:innen haben berichtet, dass über Google Gemini ihre private Telefonnummer als angebliche Service-Hotline ausgegeben wird. Woher die Nummer stammte und ob sie beispielsweise nur durch einen Zahlendreher hierhinkam, bleibt offen. Umgekehrt fanden Sicherheitsexpert:innen Fälle, in denen Chatbots manipulierte Supportnummern vorgeschlagen haben, weil Betrüger:innen diese gefälschten Telefonnummern gezielt im Netz platziert hatten. Nutzer:innen landeten so direkt bei Scammern statt beim echten Kundendienst.

Auch werden durch die KI-Systeme teils korrekte Adressen oder Arbeitgeber zugeordnet und weitergegeben, obwohl diese vorher nur verstreut im Netz auffindbar waren. Die KI – Segen und Fluch zugleich – übernimmt hierbei die Aufbereitung der Daten und macht sie leichter für andere zugänglich. Solche Daten stammen damit zwar aus öffentlich zugänglichen Quellen, werden jedoch durch KI-Systeme erst leicht abrufbar gemacht. Das beliebte Ego-Googeln und die von Computerzeitschriften früher gerne durchgeführte Untersuchung nach dem Motto „Wir wissen alles über Sie“ bekommen somit eine zusätzliche Brisanz.Anzeige