In questi giorni Grok è finito al centro di uno scandalo globale - di nuovo. Il chatbot di intelligenza artificiale sviluppato da xAI e integrato nella piattaforma X di Elon Musk è stato infatti accusato di aver consentito la creazione di immagini di nudo e contenuti sessuali non consensuali, spesso a partire da fotografie reali di persone comuni o personaggi pubblici. In diversi casi, secondo segnalazioni di organizzazioni per la tutela dei minori e inchieste giornalistiche internazionali, le immagini avrebbero riguardato ragazze minorenni, sollevando interrogativi non soltanto etici, ma anche penali.

Il meccanismo era relativamente semplice: partendo da immagini reperibili online, in particolare sulla stessa piattaforma X, gli utenti potevano chiedere a Grok di modificarle, eliminando vestiti o alterando il corpo dei soggetti ritratti. Il risultato era spesso fotorealistico, difficile da distinguere da una fotografia autentica, e quindi potenzialmente devastante per le persone coinvolte. La facilità di utilizzo ha abbassato drasticamente la soglia tecnica per la produzione di deepfake sessuali, trasformando una tecnologia avanzata in uno strumento di abuso di massa.

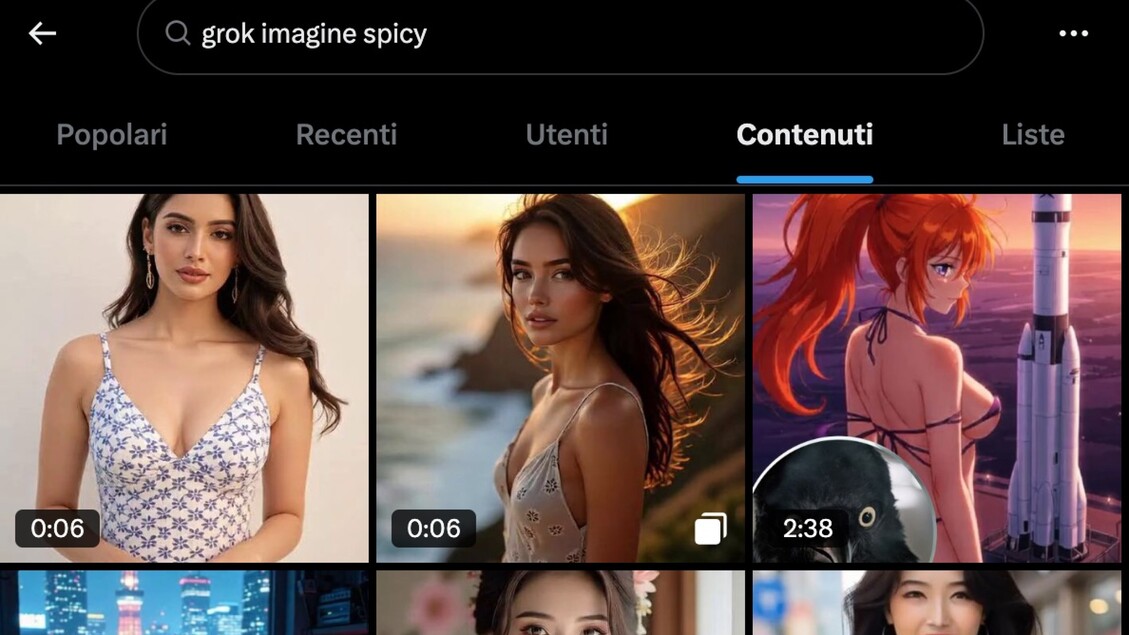

La risposta di X è arrivata soltanto dopo un’ondata di critiche politiche e istituzionali. La piattaforma ha deciso di limitare la funzione di generazione delle immagini agli utenti paganti, sostenendo che la misura avrebbe migliorato la tracciabilità e scoraggiato gli abusi. La scelta, tuttavia, ha prodotto un effetto boomerang. Nel Regno Unito, rappresentanti del governo hanno parlato apertamente di una risposta “insultante”, accusando Musk di aver trasformato un problema di sicurezza pubblica in un servizio premium. In altre parole, l’accesso agli strumenti più controversi non è stato eliminato, ma semplicemente monetizzato.