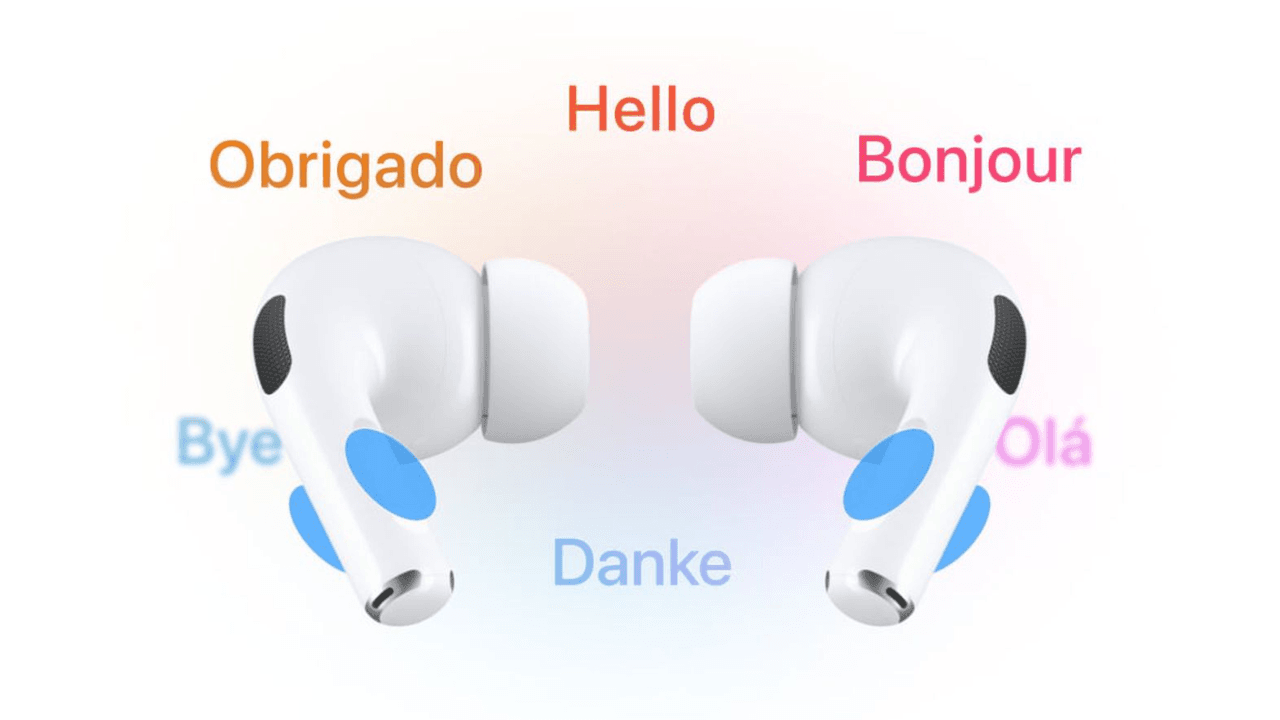

Con iOS 26.2, la più recente versione del sistema operativo per iPhone, arriva finalmente anche in Italia la funzione di traduzione simultanea (Live Translation) sugli AirPods Pro 2, Pro 3 e AirPods 4.

Con Live Translation attiva, gli utenti che indossano le cuffie possono ascoltare una conversazione in una lingua differente e ottenere una traduzione simultanea del parlato. È come avere un interprete robotico personale: la voce dell’interlocutore viene abbassata, grazie alla cancellazione attiva del rumore, mentre una voce digitale ripete la traduzione in tempo reale direttamente nelle orecchie di chi ascolta.

«L’idea alla base di Apple Intelligence è quella di utilizzare l’IA per offrire funzioni utili che possono semplificare la vita dei nostri utenti», spiega a Italian Tech Areeba Kamal, Senior Manager della divisione AIML Product Marketing di Apple. «In questo caso lo scopo era aiutare le persone a comunicare senza soluzione di continuità a prescindere dalla lingua parlata dalla persona di fronte a loro».

Come funziona la traduzione in tempo reale

La funzionalità - che al momento è ufficialmente ancora in fase beta - si trova nella versione più aggiornata dell’app Traduci di Apple e ha come prerequisito l’attivazione di Apple Intelligence a livello di sistema. La compatibilità è dunque limitata agli iPhone che possono far girare i modelli di intelligenza artificiale di Apple: 15 Pro e 15 Pro Max, tutti gli iPhone 16 e tutti gli iPhone 17. Le lingue supportate finora sono nove: inglese, italiano, spagnolo, francese, tedesco, portoghese, giapponese, coreano e cinese. In futuro, dicono da Cupertino, ne arriveranno altre.