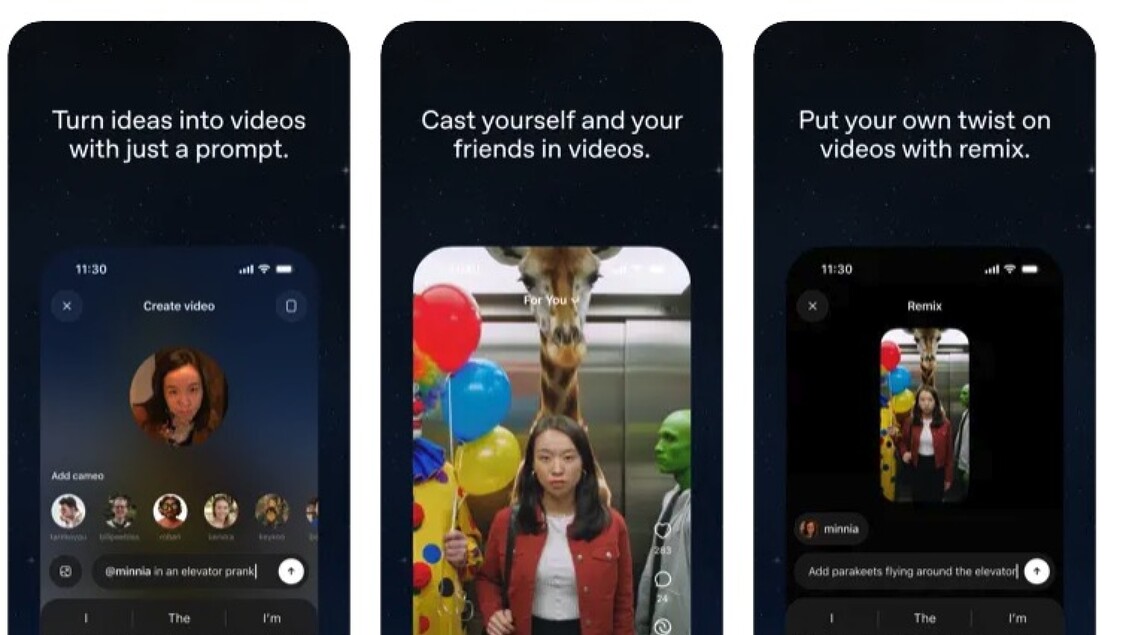

OpenAI ha presentato Sora 2, un modello di intelligenza artificiale che genera video a partire da istruzioni testuali e un’app dedicata per iOS. Non si tratta solo di un aggiornamento tecnico rispetto al primo Sora. È un cambio di strategia. L’azienda di Sam Altman entra direttamente nel terreno dei social video, lo stesso dove si muovono TikTok, YouTube e Instagram. La differenza è che i contenuti non vengono caricati dagli utenti ma generati dentro l’app. Non si possono caricare video o foto reali, una scelta fatta per limitare i deepfake.

Come funziona.

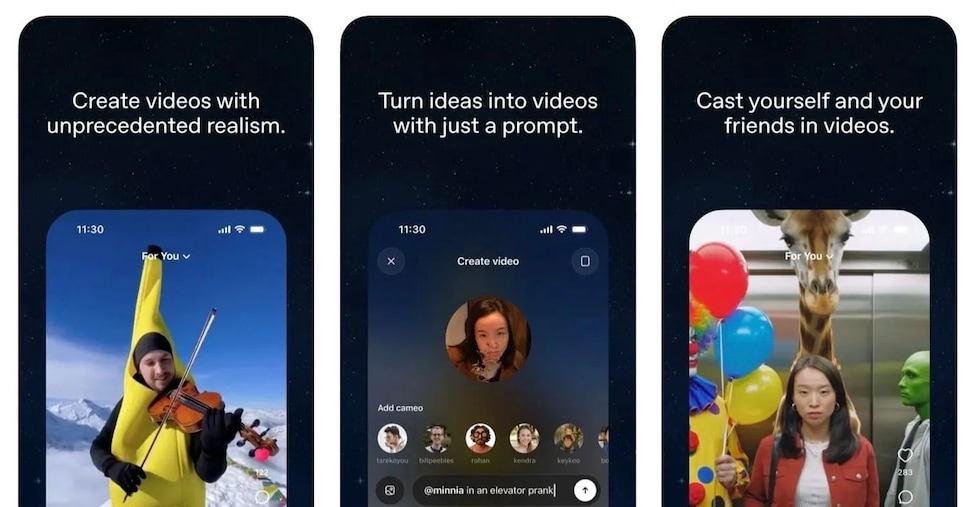

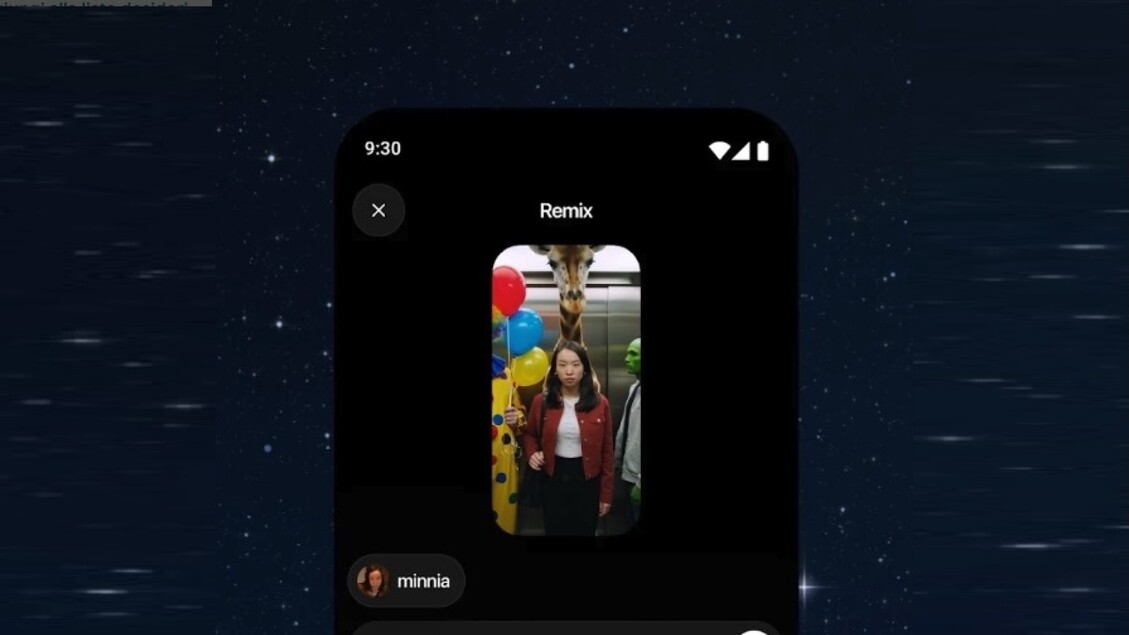

Il modello promette più realismo. Meno errori fisici, maggiore coerenza nei movimenti e audio sincronizzato. OpenAI parla di una gamma più ampia di stili, dal fotorealistico all’animazione. Ogni video è marchiato con watermark e metadati nascosti. È previsto anche un sistema di “cameo”: gli utenti possono decidere chi può usare il loro volto o la loro voce nei video e revocare il consenso in qualsiasi momento.

Tecnicaemente Sora 2 funziona come un grande modello di trasformazione multimodale: prende un testo o un prompt visivo e lo traduce in una sequenza di fotogrammi con audio coerente. Non costruisce i video fotogramma per fotogramma in modo statico, ma li genera come se stesse simulando una scena continua con attori, oggetti e movimenti. È qui la differenza rispetto a Sora 1, che spesso faticava a mantenere la coerenza temporale: un bicchiere poteva cambiare forma tra un frame e l’altro, un personaggio sparire improvvisamente, i movimenti seguire logiche poco fisiche.