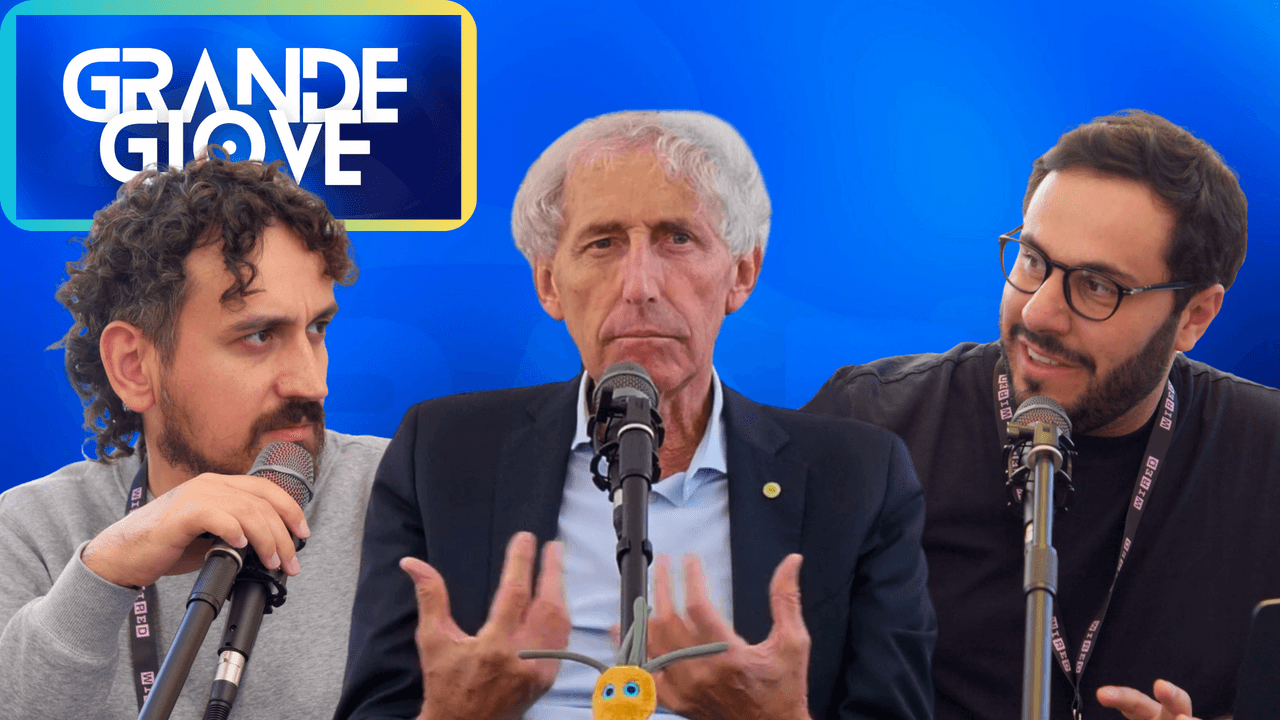

Quanto conta la scelta della lingua da utilizzare per addestrare un modello di intelligenza artificiale? E come si addestrano gli LLM, i grandi modelli linguistici, perché siano in grado di tradurre da una lingua all'altra, rispettando fedelmente il significato di ciò che leggono o ascoltano? Sono questi i temi di cui hanno discusso ai microfoni di Grande Giove Enrico Gianotti, Managing director di Cedat85, e Roberto Navigli, professore di Natural language processing a La Sapienza Università di Roma e co-founder e direttore scientifico di Babelscape.

Intanto, perché è importante la lingua scelta per addestrare un modello di AI? “Nei nostri studi abbiamo riscontrato il fatto che la cultura italiana è compresa meglio da un modello addestrato in italiano”, ha spiegato Navigli, “mentre i modelli anglofoni, anche se sono adattati all'italiano, non riescono a esprimere e a comprendere tutti i riferimenti culturali, le norme, i contesti, le espressioni anche dialettali che nella nostra lingua vengono utilizzati per esprimere la nostra cultura”.

Questo nonostante il fatto che gli LLM siano anche dei formidabili traduttori. “Questi modelli sono in grado di tradurre meglio dei sistemi nativi addestrati unicamente alla traduzione”, ha sottolineato Gianotti. Un'abilità che non deriva esclusivamente dalla quantità di dati con i quali è stato addestrato, “è come se un essere umano avesse a disposizione migliaia di anni per leggere milioni di libri”. Ma dal fatto che sono stati addestrati con libri in lingue diverse che parlano del medesimo argomento e questo facilita loro il passaggio da una lingua all'altra.