Miles Brundage, ex responsabile delle politiche di OpenAI, ha annunciato la nascita dell'AI Verification and Evaluation Research Institute (Averi).

Al sito Fortune, Brundage ha spiegato che l'idea di base è spingere le aziende che sviluppano intelligenze artificiali a far valutare i loro modelli da enti terzi e non solo da procedure interne. "In un certo senso, oggi ognuno scrive le proprie regole", ha detto a Fortune, "le compagnie stanno definendo in autonomia le norme".

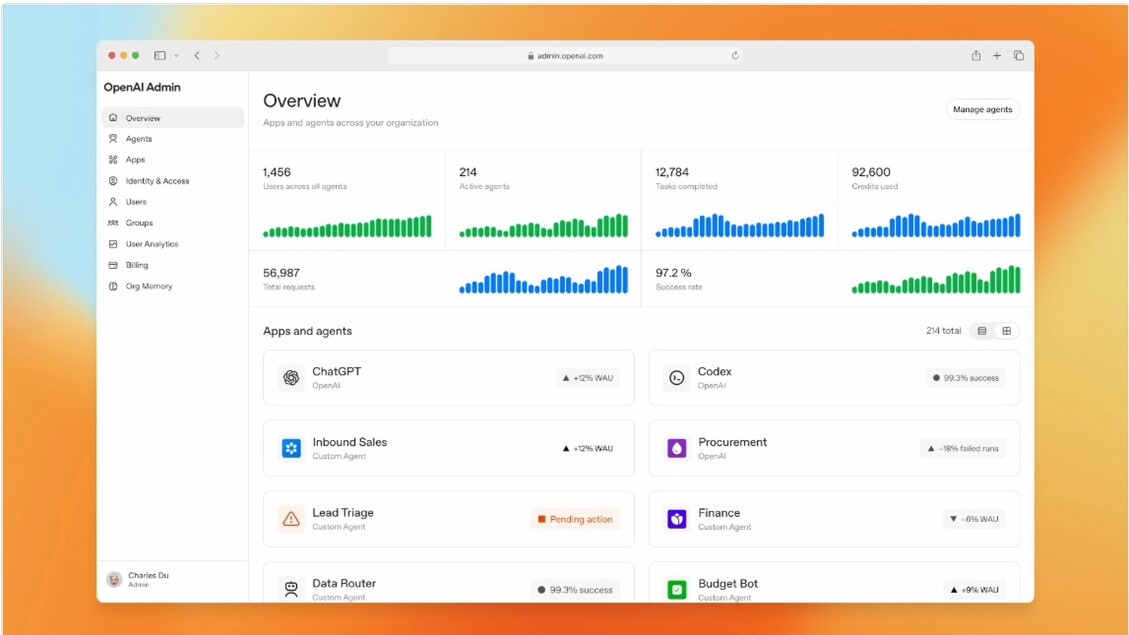

Brundage è stato per sette anni ricercatore e consulente di OpenAI, da cui è uscito nel 2024. Insieme all'annuncio, Averi ha pubblicato sul sito ufficiale i passaggi previsti per la verifica dei modelli. L'istituto propone un quadro di "garanzia dell'IA" che va dal livello 1, con test generali, al livello 4, che copre i requisiti internazionali sulla sicurezza dell'IA.

Fortune sottolinea che sebbene i principali laboratori di intelligenza artificiale conducano test di sicurezza e pubblichino report tecnici sui risultati di molte di queste valutazioni, "consumatori, aziende e governi devono semplicemente fidarsi di ciò che i test affermano. Nessuno li obbliga a condurre valutazioni o a riportarle secondo un insieme specifico di standard".