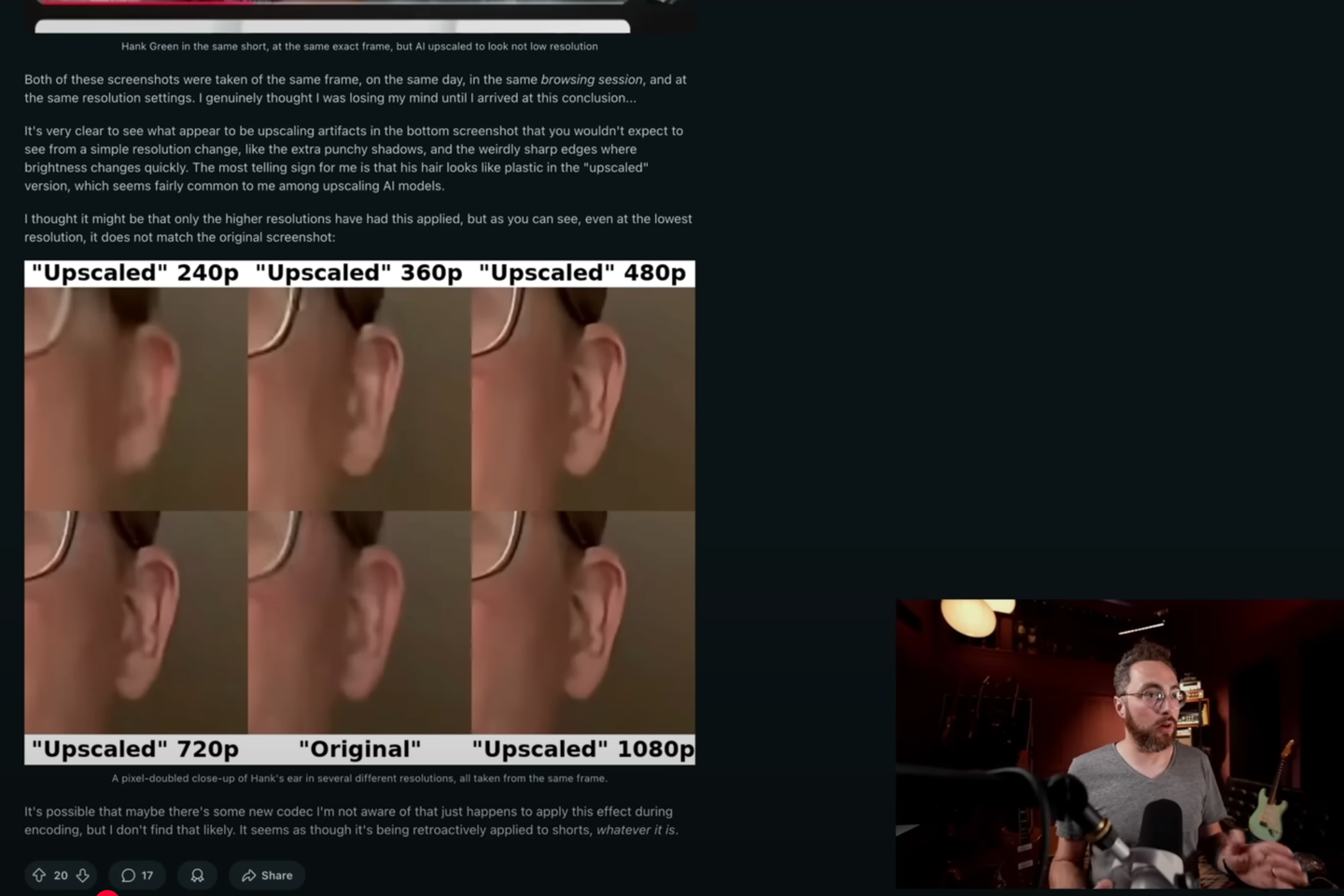

Dès le mois de juin, les premiers avertissements inquiets commencent à apparaître sur le forum Reddit. Quelques créateurs s’alarment de l’apparence des vidéos publiées récemment sur YouTube : certains y décèlent un effet « peinture à l’huile », d’autres un aspect « plastique » leur faisant penser à la marque d’un traitement par intelligence artificielle (IA).

Toutefois, il faut attendre mercredi 20 août, cette fois sur le réseau social X, pour que le soupçon se confirme. En guise d’expérimentation, l’entreprise utilise bien un « procédé traditionnel de “machine learning” [“apprentissage automatique”] pour déflouter, “débruiter” et améliorer la clarté » d’une partie des « shorts », les vidéos courtes et verticales de YouTube, révèle alors Rene Ritchie, chargé pour YouTube des relations avec les créateurs.

En employant le vocable « machine learning », la plateforme se garde d’employer les termes « intelligence artificielle », qui évoquent sans doute trop les IA génératives, outils apparus dans les années 2020 et qui permettent de créer des vidéos de toutes pièces sur la base d’une simple consigne textuelle. A l’inverse, le « machine learning » peut passer pour une technologie plus traditionnelle, car il est employé dans le domaine de la vidéo depuis les années 2010, notamment par les téléviseurs, afin d’améliorer leur qualité d’image.