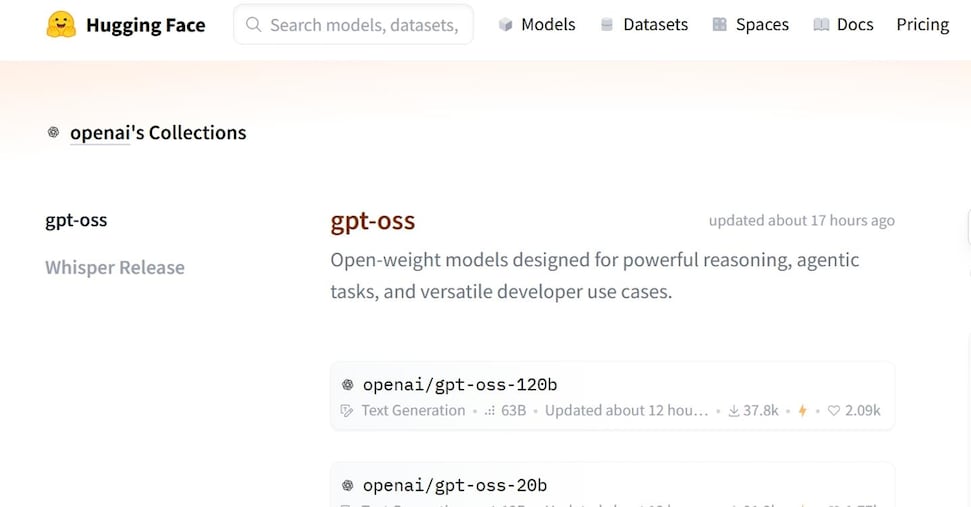

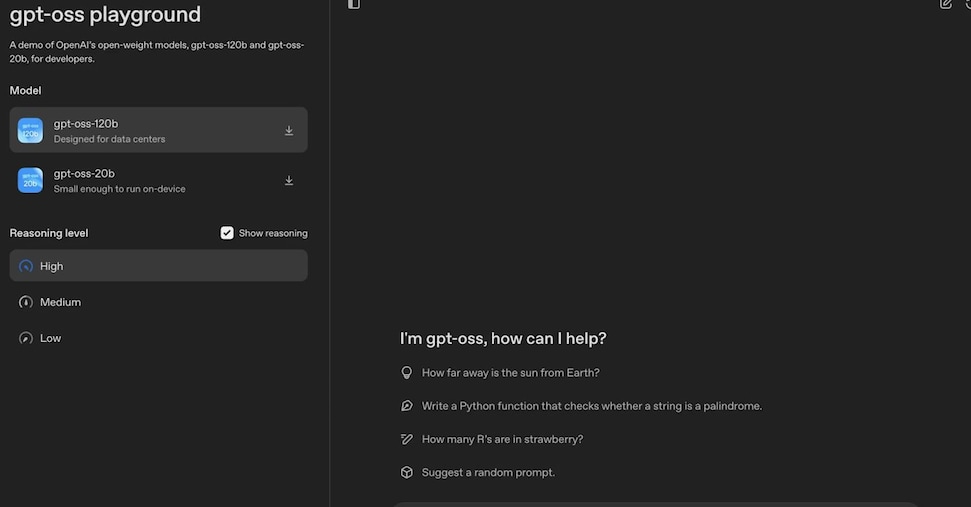

Potrebbe non essere Gpt-5 la vera novità di agosto di OpenAI. Da un punto di vista strategico Gpt-oss-120b e gpt-oss-20b, i suoi primi modelli open-weight dal lontano 2019, ovvero dai tempi di GPT-2 rappresentano una svolta più significativa rispetto alla nuovo e discussa versione di ChatGPT-5. Prima di tutto una spiegazione; «Open-weight» non significa «open source» in senso pieno, ma piuttosto che i parametri che definiscono il comportamento del modello, sono liberamente scaricabili e modificabili grazie a una licenza permissiva Apache 2.0.

È un cambio radicale di paradigma: prima, solo cloud proprietario; adesso, modelli forti e trasparenti accessibili a tutti, dalla grande azienda al ricercatore in pigiama. Il modello più grande – gpt-oss-120b – conta 117 miliardi di parametri, ma solo 5,1 miliardi vengono attivati per token, usando la tecnica del mixture-of-experts (MoE). Il «piccolo» gpt-oss-20b (21 mld di parametri, 3,6 attivati) promette di girare su un portatile con soli 16 GB di RAM.

Perché è importante? Immagina di avere sotto mano non solo l’assistente che ti risponde, ma la macchina stessa: puoi esplorarla, adattarla, sperimentare. Vuoi farlo ragionare diversamente, meglio, trasformarlo in un agente operativo? Adesso puoi.