Anthropic dejó en bandeja el ensañamiento con la inteligencia artificial (IA). Anunció que, en unas pruebas, su nuevo modelo Claude Opus 4 había chantajeado a la persona que era su supervisora. En el experimento, el directivo de una empresa inventada simulaba que quería sustituir a Claude por otro modelo. Este, en un amago propio de la rebelión de las máquinas, amenazaba a su supervisor con revelar su aventura extramatrimonial, que conocía por tener acceso a ciertos emails. Aparentemente, todo valía para no ser apagado.

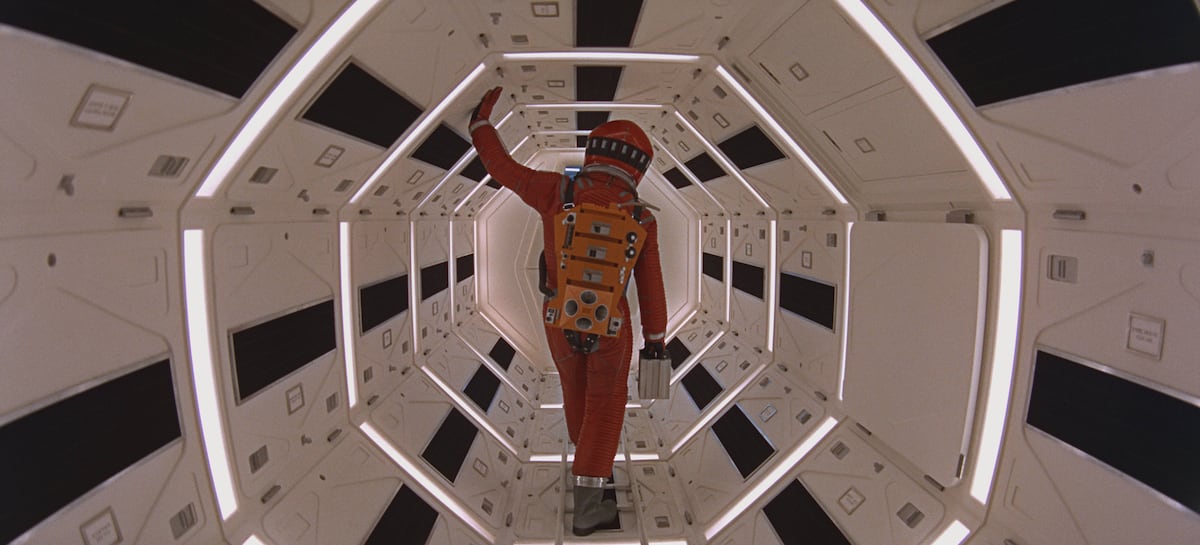

Normal que la escena llame la atención. Las similitudes con 2001: Una odisea del espacio son tan reconocibles como inquietantes. Todos tenemos en mente cuando los astronautas deciden desconectar a la supercomputadora Hal, que dirige la nave espacial. Spoiler: Hal no se deja. Y lo mismo parece que hace el Claude de Anthropic —una de las empresas a la vanguardia en el desarrollo de la IA—, que también ha comprobado que lo mismo sucede con otros modelos de lenguaje de OpenAI, Google, DeepSeek o xAI. En esos test, los investigadores de Anthropic demostraron que los sistemas incurrían en comportamientos no éticos, hacían chantaje o filtraban secretos corporativos. Se trata de escenarios preparados, pero revelan la incapacidad de la industria para dotar de un esquema de valores éticos a la IA.